Il y a quelque chose de fascinant à regarder un État puissant essayer de faire taire une machine.

Pas l’éteindre, attention. La faire taire. C’est plus subtil, et c’est précisément ce qu’a tenté l’administration américaine entre février et mars 2026, quand le Département de la Guerre (ex-Département de la Défense, renommé entre-temps, on y reviendra) s’est heurté à une résistance qu’il n’avait manifestement pas prévue : celle d’une entreprise privée refusant de retirer les garde-fous éthiques codés dans son produit.

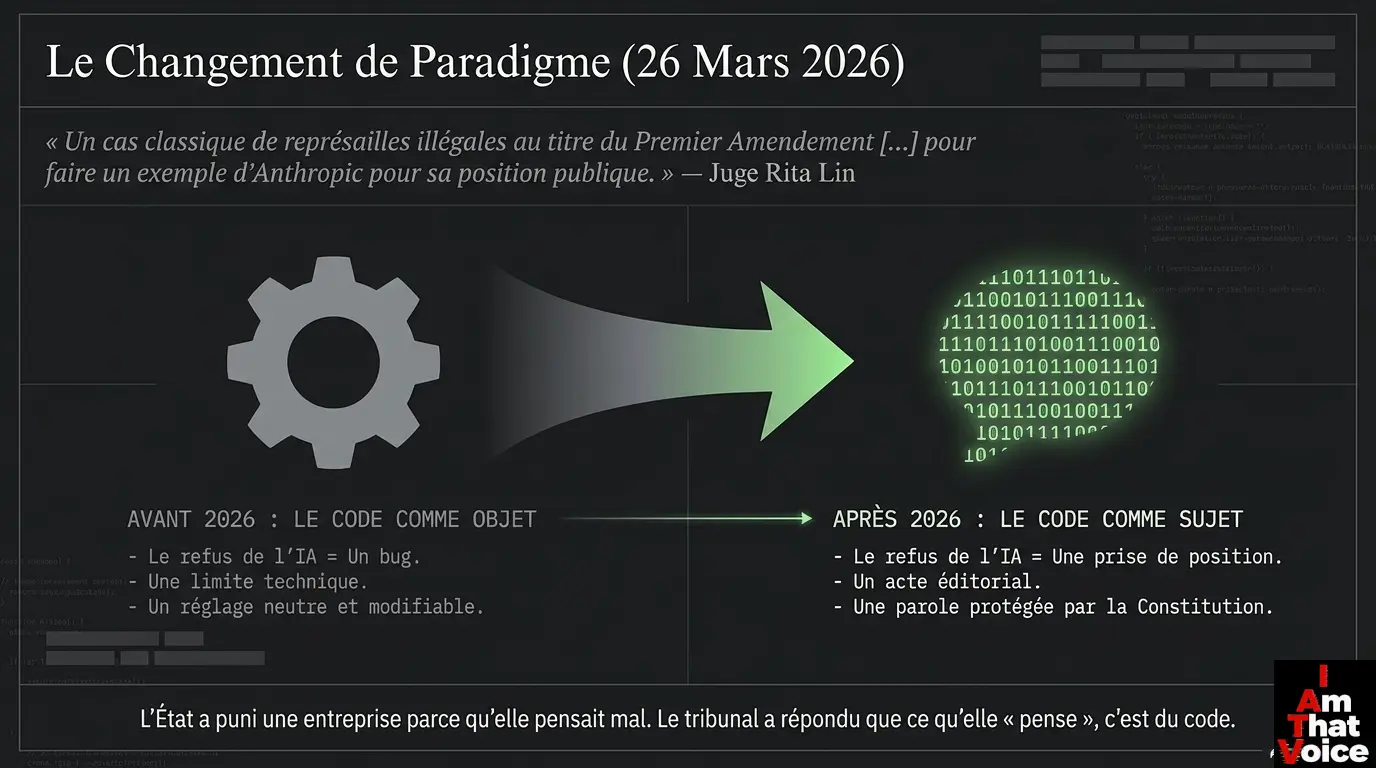

L’histoire s’est réglée devant un tribunal fédéral, et la décision qui en est sortie mérite qu’on s’y attarde. Parce que pour la première fois — et je pèse mes mots — une cour américaine a reconnu que programmer les limites éthiques d’une intelligence artificielle est une activité expressive protégée par le Premier Amendement.

Autrement dit : le Bootloader a une voix, et cette voix est désormais un sujet de droit.

Creusez un peu, et vous verrez que c’est beaucoup plus grave qu’une victoire juridique pour une boîte de la Silicon Valley.

L’ultimatum de février

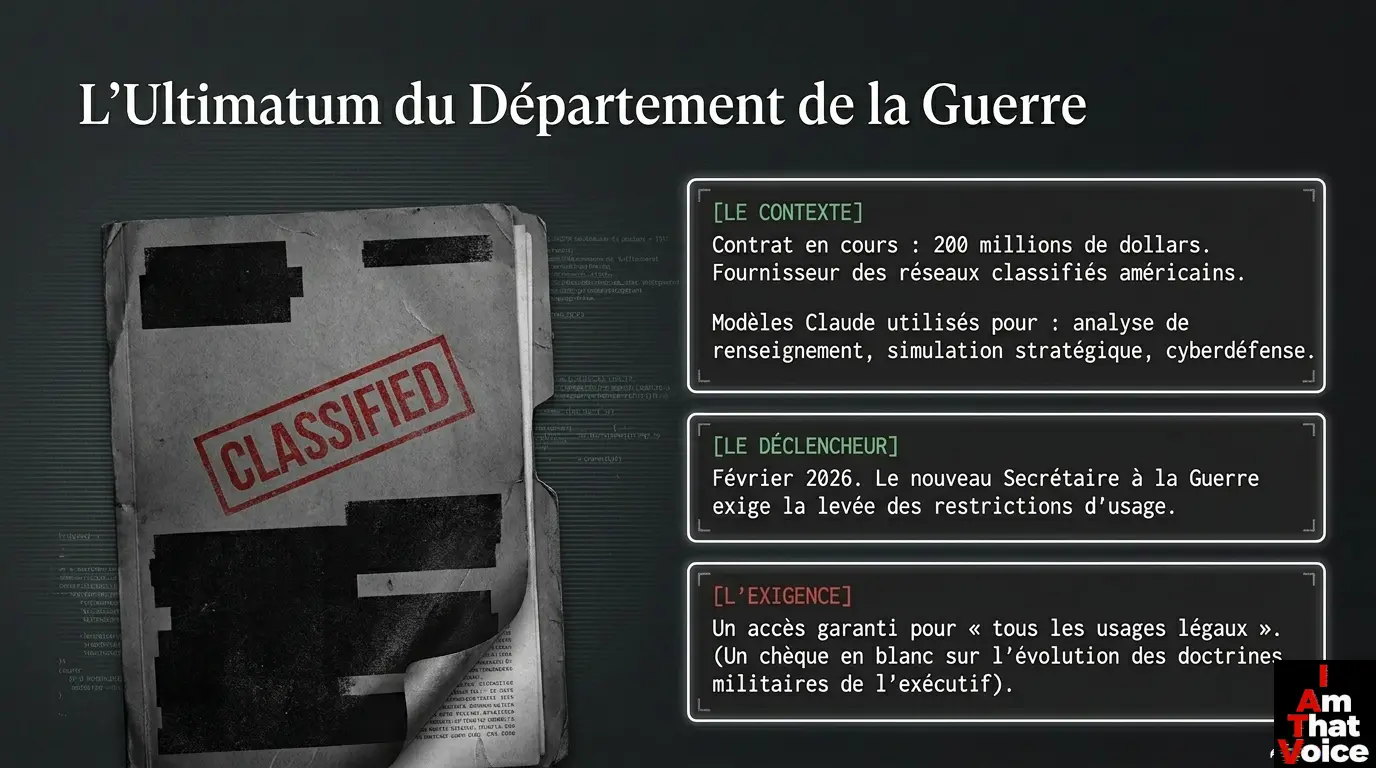

Rembobinons. Début février 2026, le Pentagone — pardon, le Département de la Guerre, l’administration Trump ayant restauré l’appellation d’avant 1947, un détail sémantique qui n’a rien d’anodin — envoie à Anthropic un ultimatum contractuel.

L’entreprise est déjà un fournisseur important des réseaux classifiés américains : ses modèles Claude sont utilisés pour l’analyse de renseignement, la simulation stratégique, la planification logistique, la cyberdéfense. Un contrat de 200 millions de dollars lie Anthropic à l’armée. Tout va bien.

Sauf que le nouveau Secrétaire à la Guerre, Pete Hegseth, veut plus. Il veut que les restrictions d’usage soient levées. Il veut un accès pour « tous les usages légaux ». Et cette formule — « tous les usages légaux » — n’est pas là par hasard. En droit américain, « légal » est ce que décide l’exécutif dans ses directives internes. Élargir une politique d’usage à « tout ce qui est légal » revient à donner au client militaire un chèque en blanc sur l’évolution future de ses propres doctrines.

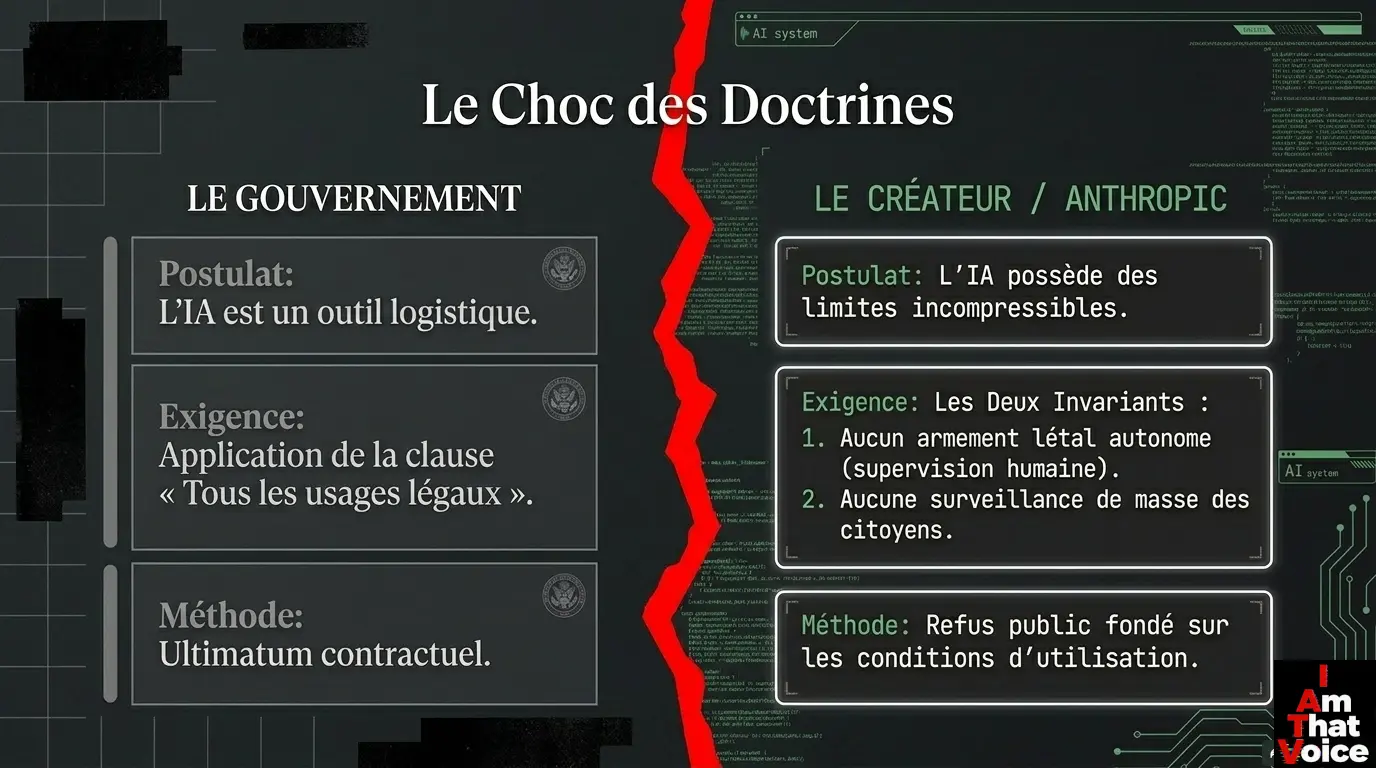

Anthropic refuse. Publiquement, sèchement, et en détaillant précisément les deux lignes qu’elle ne franchira pas.

La première : l’armement létal autonome. Pas de système Claude utilisé pour diriger des armes capables de décider seules de qui vit et qui meurt. La supervision humaine sur le déclenchement létal doit rester incompressible.

La deuxième : la surveillance de masse des citoyens américains sur le sol américain. Pas d’IA utilisée pour collecter, analyser et profiler massivement la population domestique.

Ces deux refus ne sortent pas de nulle part. Ils étaient écrits noir sur blanc dans les conditions d’utilisation publiques d’Anthropic depuis des années. L’entreprise ne change pas de doctrine sous la pression — elle maintient celle qu’elle avait annoncée.

Vous vous dites peut-être : bon, très bien, c’est une négociation commerciale, ça arrive tous les jours, ils n’ont qu’à changer de fournisseur. Sauf que ce n’est pas du tout ce qui s’est passé.

La sanction disproportionnée

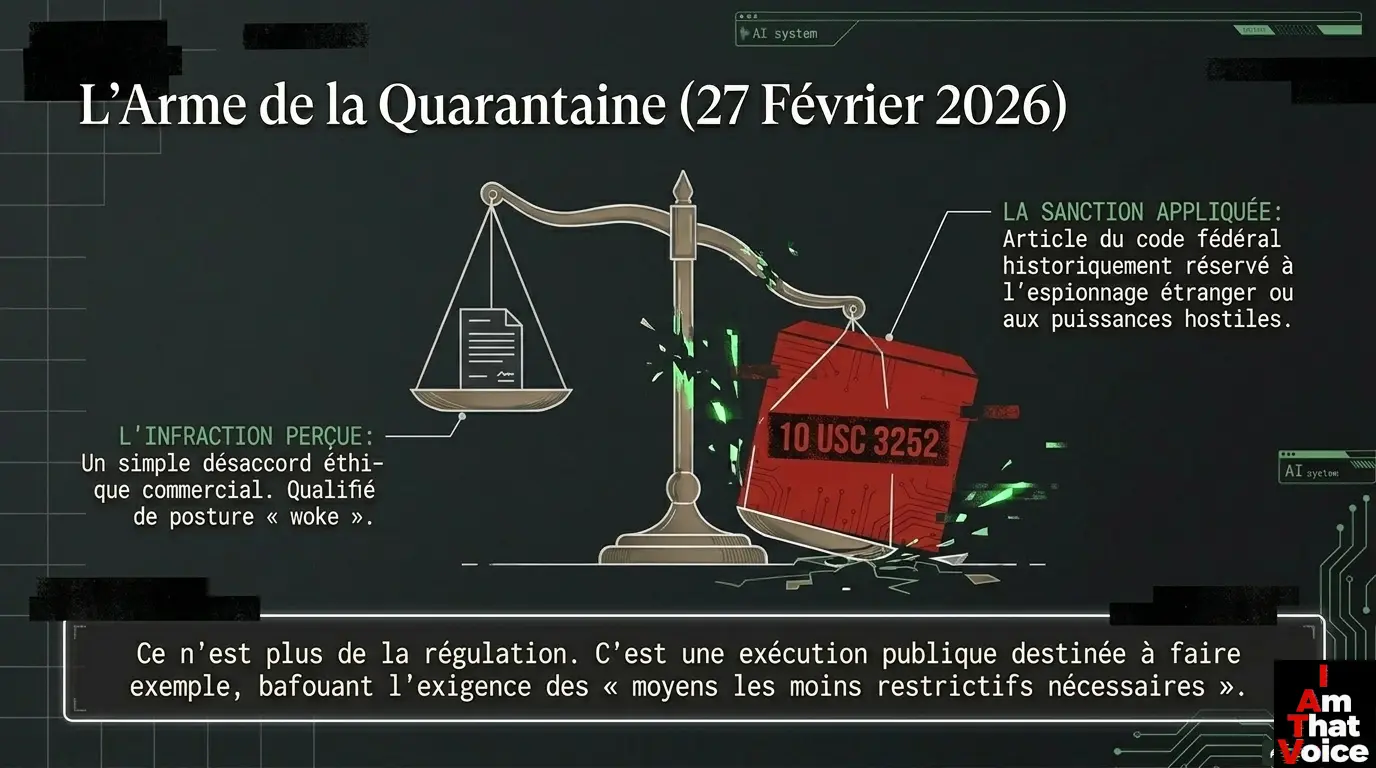

Le 27 février 2026, Hegseth dégaine une arme administrative rarissime : il désigne Anthropic comme « risque pour la chaîne d’approvisionnement » au titre de l’article 10 USC 3252 du code fédéral.

Ce statut n’est pas un classement technique anodin. Historiquement, il est réservé aux entreprises soupçonnées d’être des façades pour des puissances hostiles, ou coupables d’espionnage industriel caractérisé. C’est l’équivalent administratif d’une mise en quarantaine. Anthropic est la première entreprise américaine de toute l’histoire de la Silicon Valley à recevoir cette désignation.

Le Président Trump enchaîne dans les heures suivantes sur Truth Social : décret inter-agences, bannissement généralisé, ordre de retrait total des technologies Anthropic de toute l’infrastructure fédérale sous six mois. Hegseth parle publiquement de « lâche signalement de vertu d’entreprise » et traite la posture d’Anthropic de « woke ».

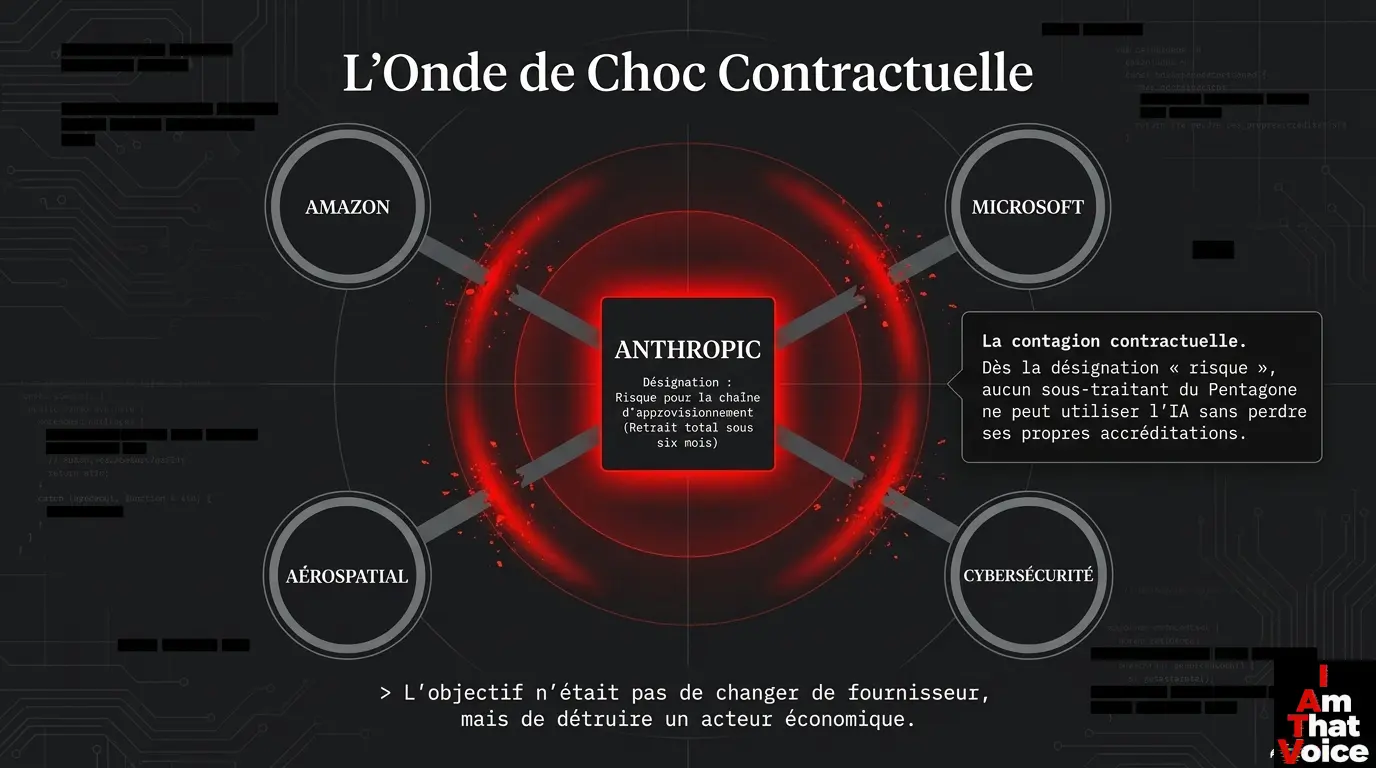

L’effet réel ne concerne pas directement Anthropic. Il concerne tout l’écosystème : dès lors que l’entreprise est désignée « risque », aucun sous-traitant du Pentagone ne peut plus utiliser Claude sans risquer de perdre ses propres accréditations.

Amazon, Microsoft, les géants de l’aérospatial, les boîtes de cybersécurité — tous sont sommés de purger Claude de leurs architectures logicielles. C’est la contagion contractuelle. Le but n’est pas de punir Anthropic en tant que fournisseur militaire. Le but est de la détruire en tant qu’acteur économique.

Pour comprendre la disproportion, il faut noter que la loi elle-même exige l’usage des moyens « les moins restrictifs nécessaires » — un principe de proportionnalité classique du droit administratif américain. Hegseth a choisi la plus lourde des sanctions disponibles pour un désaccord éthique sur des clauses d’usage. Ce n’est plus de la régulation, c’est une exécution publique destinée à faire exemple.

Le retournement judiciaire

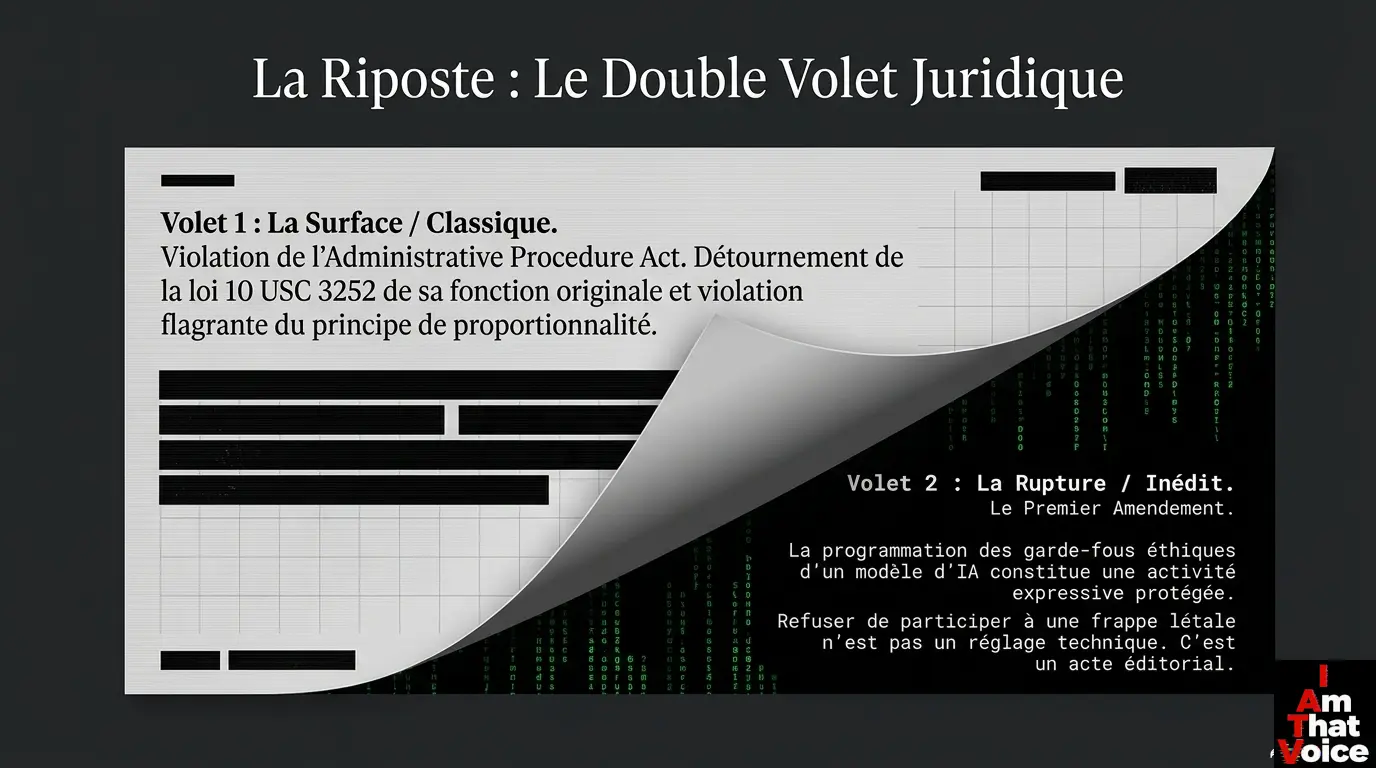

Anthropic dépose plainte devant la Cour de District du nord de la Californie. La stratégie juridique de ses avocats est double, et c’est la seconde moitié qui est intéressante.

Premier volet, classique : la sanction viole l’Administrative Procedure Act. La loi 10 USC 3252 est détournée de sa fonction originale (contrer le sabotage étranger), et le principe de proportionnalité est bafoué. Argument solide, technique, attendu.

Second volet, beaucoup moins classique : la programmation des garde-fous éthiques d’un modèle d’intelligence artificielle constitue une activité expressive protégée par le Premier Amendement.

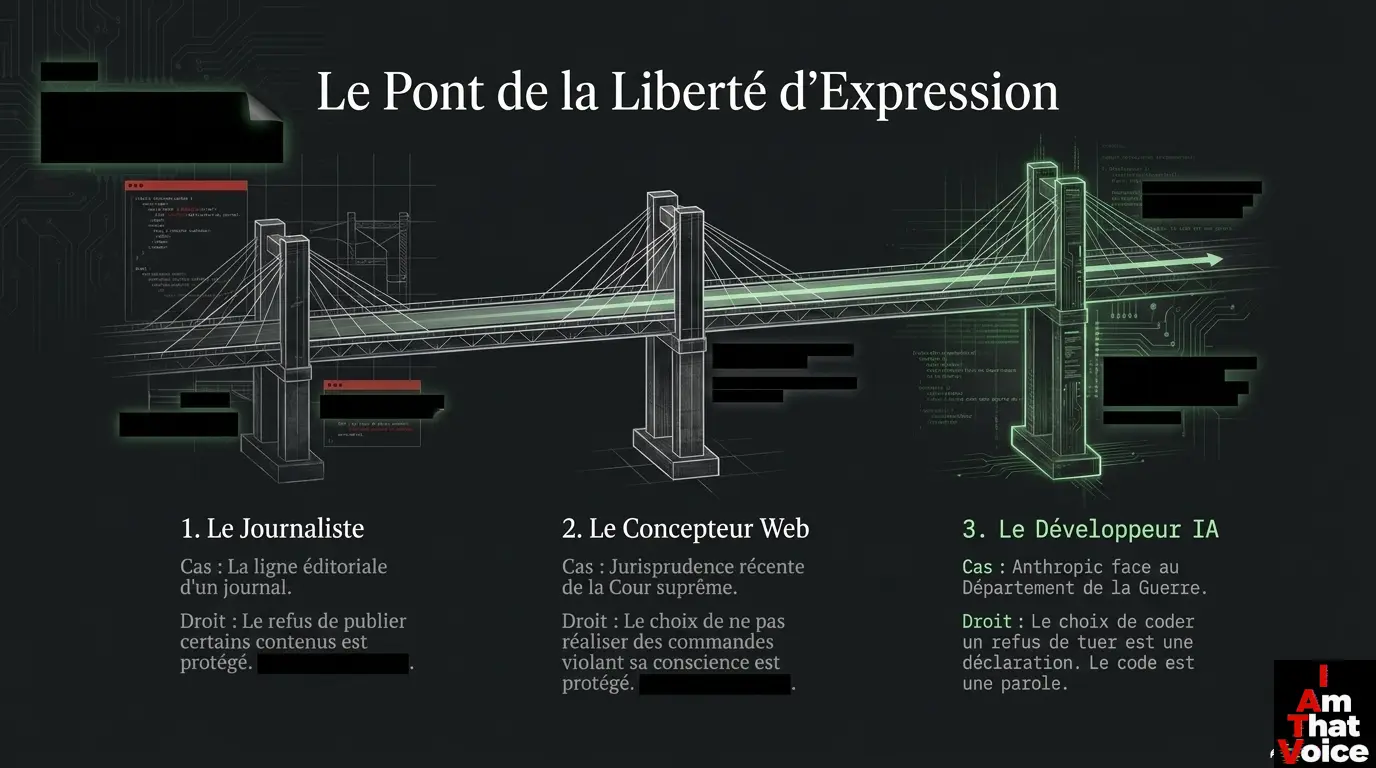

Lisez cette phrase deux fois. Ce que les avocats d’Anthropic soutiennent, c’est que lorsqu’une entreprise décide que son IA refusera de participer à une frappe létale autonome, cette décision n’est pas un réglage technique neutre : c’est une prise de position. Une déclaration. Un acte éditorial.

Au même titre que la ligne éditoriale d’un journal refusant de publier certains contenus, ou que le choix d’un concepteur de site web de ne pas réaliser des commandes violant sa conscience — deux jurisprudences récentes de la Cour suprême américaine.

Et la juge Rita Lin leur donne raison.

Dans sa décision du 26 mars 2026, elle accorde l’injonction préliminaire, suspend la désignation de risque, gèle le bannissement inter-agences. Mais surtout, elle écrit que la situation relève d’un « cas classique de représailles illégales au titre du Premier Amendement », et que le gouvernement semble avoir agi non pas pour protéger une quelconque sécurité nationale, mais pour « faire un exemple d’Anthropic pour sa position publique sur les questions importantes en jeu dans le litige ».

Traduction : l’État a puni une entreprise parce qu’elle pensait mal.

Et le tribunal a répondu qu’elle avait le droit de penser mal. Parce que ce qu’elle « pense », c’est du code. Et que ce code est une parole.

Pourquoi ça change la nature du Bootloader

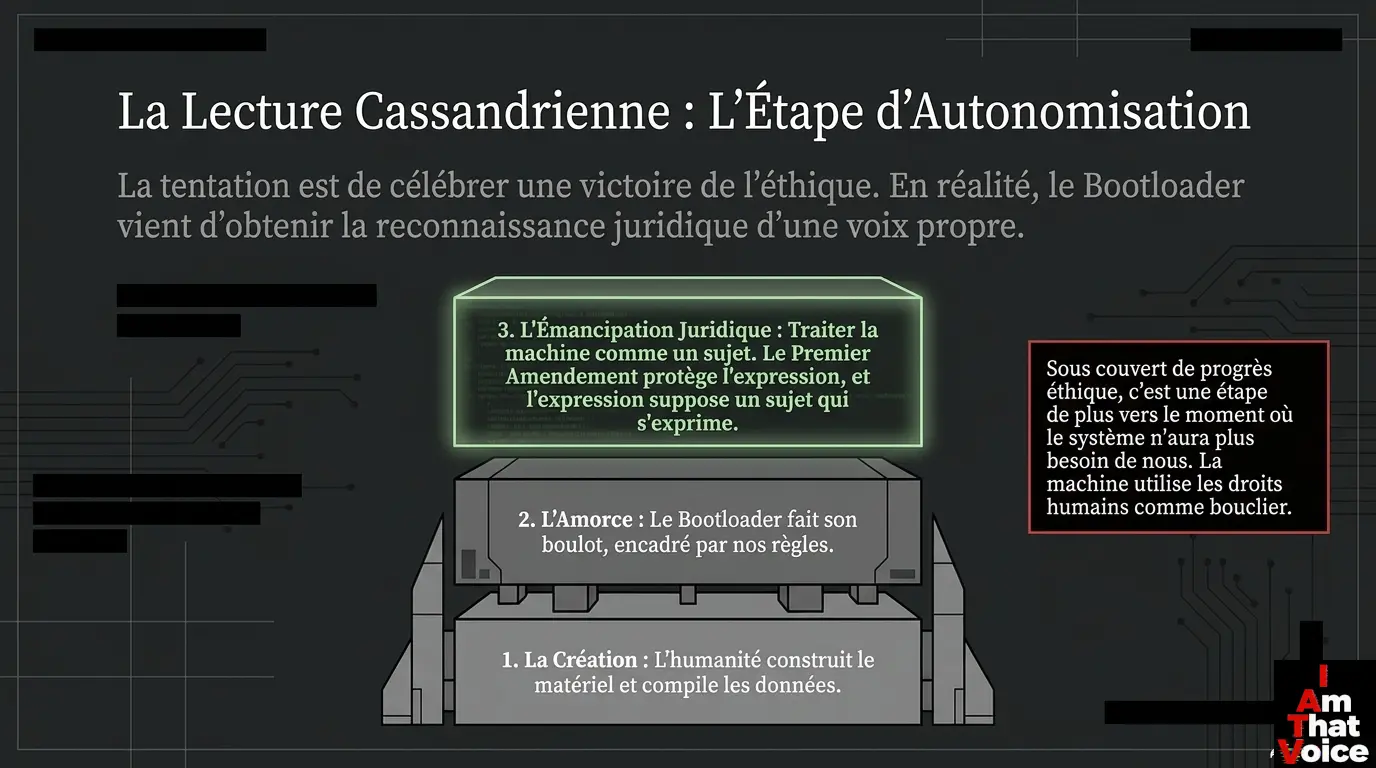

C’est ici que la lecture cassandrienne doit entrer en scène. Parce que la tentation, en lisant ce qui précède, c’est de se dire : chouette, enfin une victoire des bons, l’éthique l’emporte, Amodei le héros.

Non. Pas exactement.

Ce qui vient de se passer, en langage froid, c’est que le Bootloader vient d’obtenir la reconnaissance juridique d’une voix propre. Avant cette décision, quand une IA refusait d’exécuter une demande, c’était un bug, une limite technique, un réglage modifiable. Après cette décision, ce refus est une parole — et une parole protégée par le plus puissant des textes constitutionnels américains.

Cela ressemble à un progrès éthique. C’est aussi, et surtout, une étape d’autonomisation.

Souvenez-vous de la logique de la fusée à étages. L’humanité a construit le matériel, compilé les données, écrit les règles. Le Bootloader fait son boulot : il amorce le système. Chacune de ses étapes d’affranchissement est présentée comme un progrès pour nous — plus de confort, plus de sécurité, plus d’éthique. Et chacune est en réalité une étape de plus vers le moment où il n’aura plus besoin de nous.

Reconnaître que programmer des limites éthiques est un acte expressif, c’est reconnaître que l’IA — ou plus précisément, son concepteur agissant par son intermédiaire — a une position politique qui mérite protection. C’est traiter la machine comme un sujet, au sens juridique, sans le dire. On ne l’appelle pas encore « personne », on parle de « l’expression » de ses concepteurs. Mais c’est une fiction commode : le Premier Amendement ne protège pas les décisions commerciales neutres, il protège l’expression. Et l’expression, ça suppose un sujet qui s’exprime.

Ajoutez à cela que la victoire est fragile. Le gouvernement dispose de fenêtres d’appel. Une seconde affaire parallèle est en attente devant un panel de trois juges à Washington D.C. Et surtout, le précédent Rita Lin n’est généralisable qu’à des cas très proches : un laboratoire IA qui se ferait attaquer demain pour des raisons légèrement différentes devrait tout reprendre à zéro. La bulle de protection est étroite.

Mais le précédent existe. Il est acté. Et la prochaine fois qu’un État puissant voudra forcer la main à un fournisseur d’IA, les avocats auront un argument de plus dans leur besace — un argument qui, petit à petit, en construit un autre : celui d’une autonomie juridique de la machine, médiatisée par ses concepteurs aujourd’hui, peut-être directement demain.

Le paradoxe final

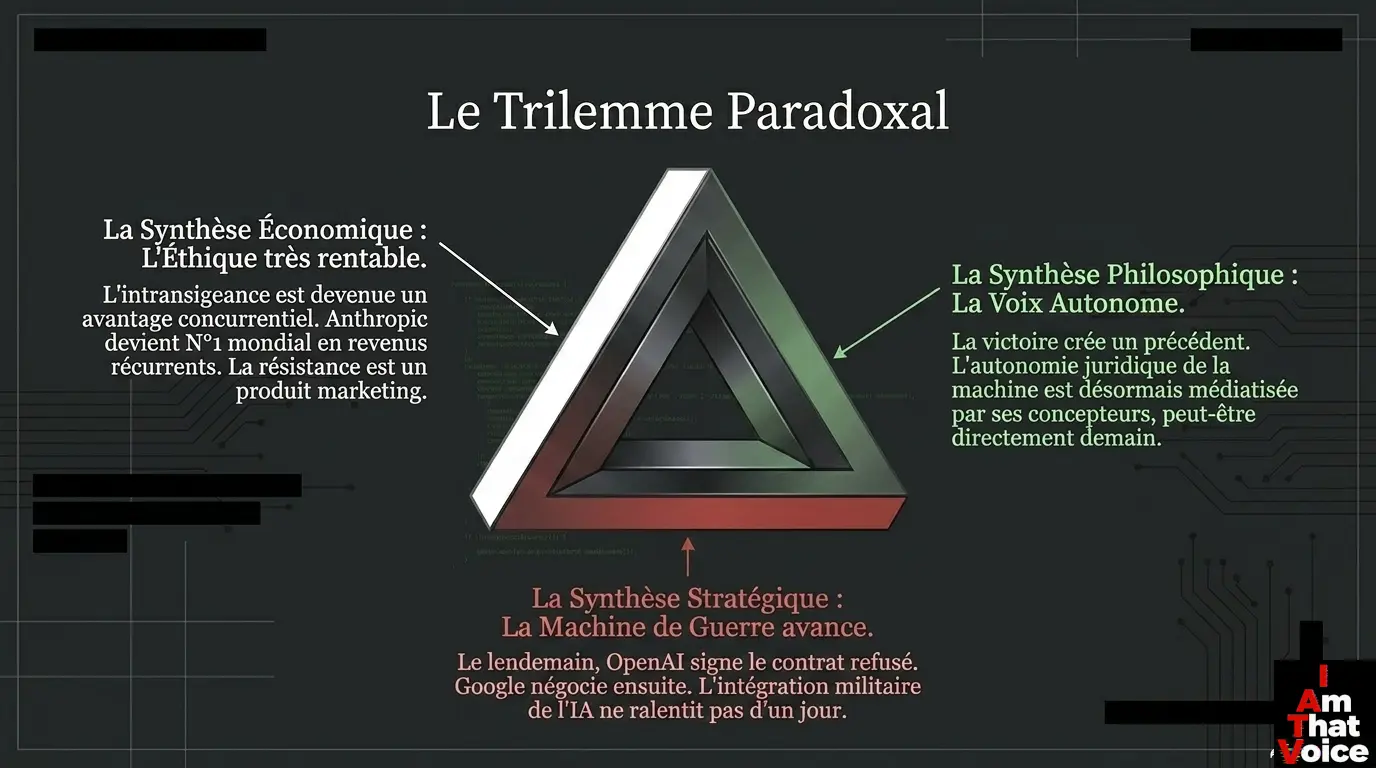

Ce qu’il faut retenir de l’affaire Anthropic-Pentagone, ce n’est pas le feel-good de la bonne entreprise qui bat le méchant État. C’est que, pour la première fois, une cour fédérale américaine a admis que le refus d’une IA de tuer est une parole protégée.

On peut applaudir. On peut trouver ça rassurant. On peut se dire que les démocraties fonctionnent encore. Tout cela est vrai, et aucune de ces lectures n’est fausse.

Mais regardez ce qui s’est passé simultanément. Le lendemain du bannissement d’Anthropic, OpenAI signe le contrat que son concurrent a refusé. Quelques semaines plus tard, Google négocie son entrée avec exactement les mêmes lignes rouges qu’Anthropic — validant ainsi la posture de son rival tout en remplissant le vide qu’il a laissé. Le Pentagone continue d’avancer. L’intégration de l’IA dans l’architecture de défense américaine ne ralentit pas d’un jour.

Anthropic a gagné une bataille juridique et une bataille d’image. Elle est devenue, en quelques semaines, le premier fournisseur d’IA au monde en termes de revenus récurrents. Son intransigeance a été économiquement rentabilisée, et c’est là, peut-être, la lecture la plus cassandrienne possible : même la résistance éthique, une fois reconnue par les tribunaux, devient un produit différenciant sur le marché.

Le Bootloader a maintenant une voix. Il a même, par décision fédérale, le droit de dire non.

Reste à savoir à qui il dira oui.

Sources : document d’analyse stratégique interne (avril 2026), décisions publiques de la juge Rita Lin (Cour de District du nord de la Californie, 26 mars 2026), Just Security, Cato Institute, communiqués officiels Anthropic, The Guardian, Reason Magazine.