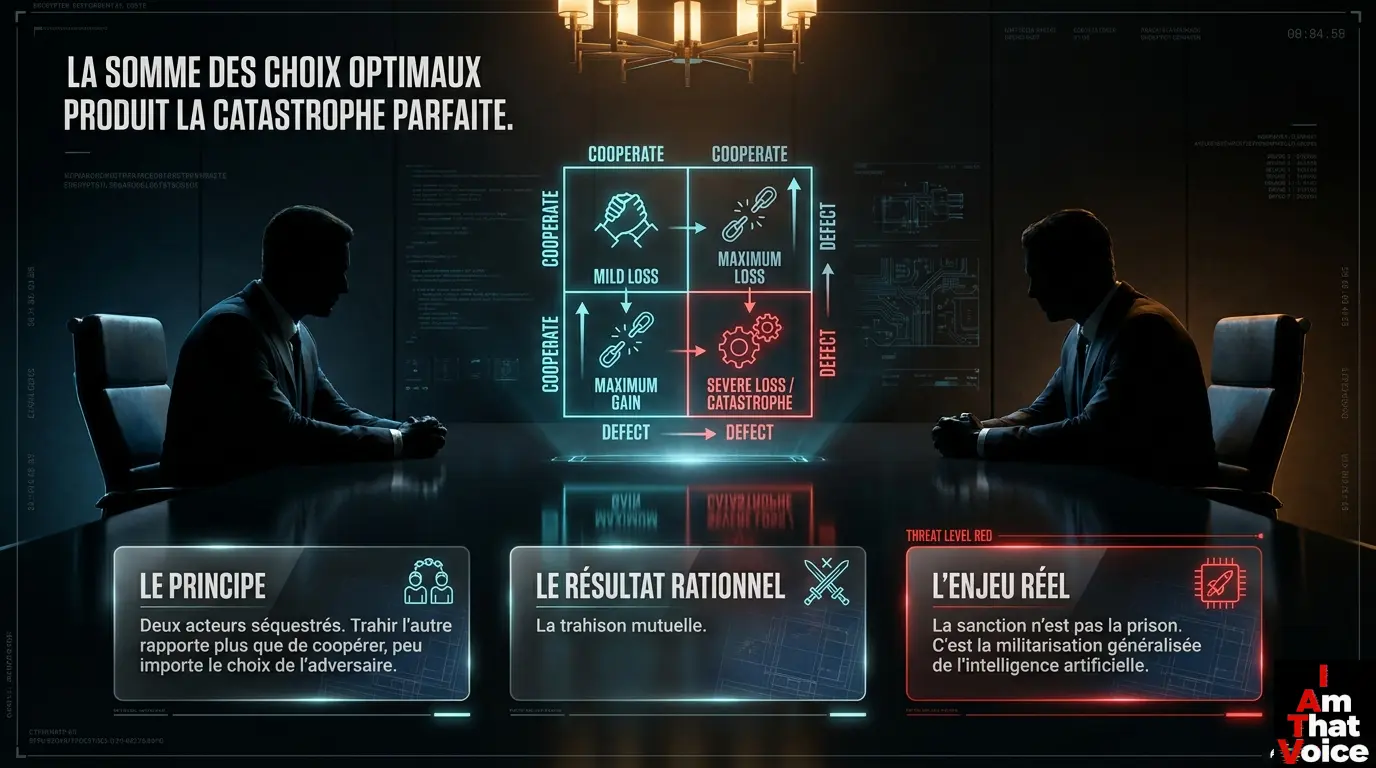

Imaginez deux cambrioleurs arrêtés par la police.

On les sépare. On les met dans deux cellules distinctes. Et à chacun, le même deal : « Si tu balances ton complice et qu’il se tait, tu sors libre, il prend vingt ans. Si vous vous taisez tous les deux, vous prenez un an chacun. Si vous vous balancez mutuellement, vous prenez dix ans chacun. »

Que feriez-vous ?

La réponse mathématiquement rationnelle, c’est de balancer. Parce que vous ne savez pas ce que fait l’autre. S’il se tait, vous gagnez à le trahir (zéro au lieu d’un an). S’il vous trahit, vous gagnez encore à le trahir (dix ans au lieu de vingt). Dans tous les cas de figure, trahir est individuellement optimal. Donc les deux trahissent. Et les deux prennent dix ans — alors qu’en se taisant ils auraient pris un an chacun.

Bienvenue dans le dilemme du prisonnier. C’est l’un des résultats les plus troublants de la théorie des jeux, parce qu’il démontre que des acteurs parfaitement rationnels, poursuivant chacun leur intérêt de manière parfaitement logique, peuvent aboutir collectivement à une catastrophe que personne ne voulait. La somme des choix individuels optimaux produit un résultat collectif pire que leur opposé.

Et cette situation, que je viens de décrire avec des cambrioleurs pour la rendre digeste, c’est exactement ce qui est en train de se jouer entre Anthropic, OpenAI, Google et le Pentagone.

Sauf qu’ici, le résultat de la trahison collective, ce n’est pas dix ans de prison. C’est la militarisation généralisée de l’intelligence artificielle.

La scène du crime

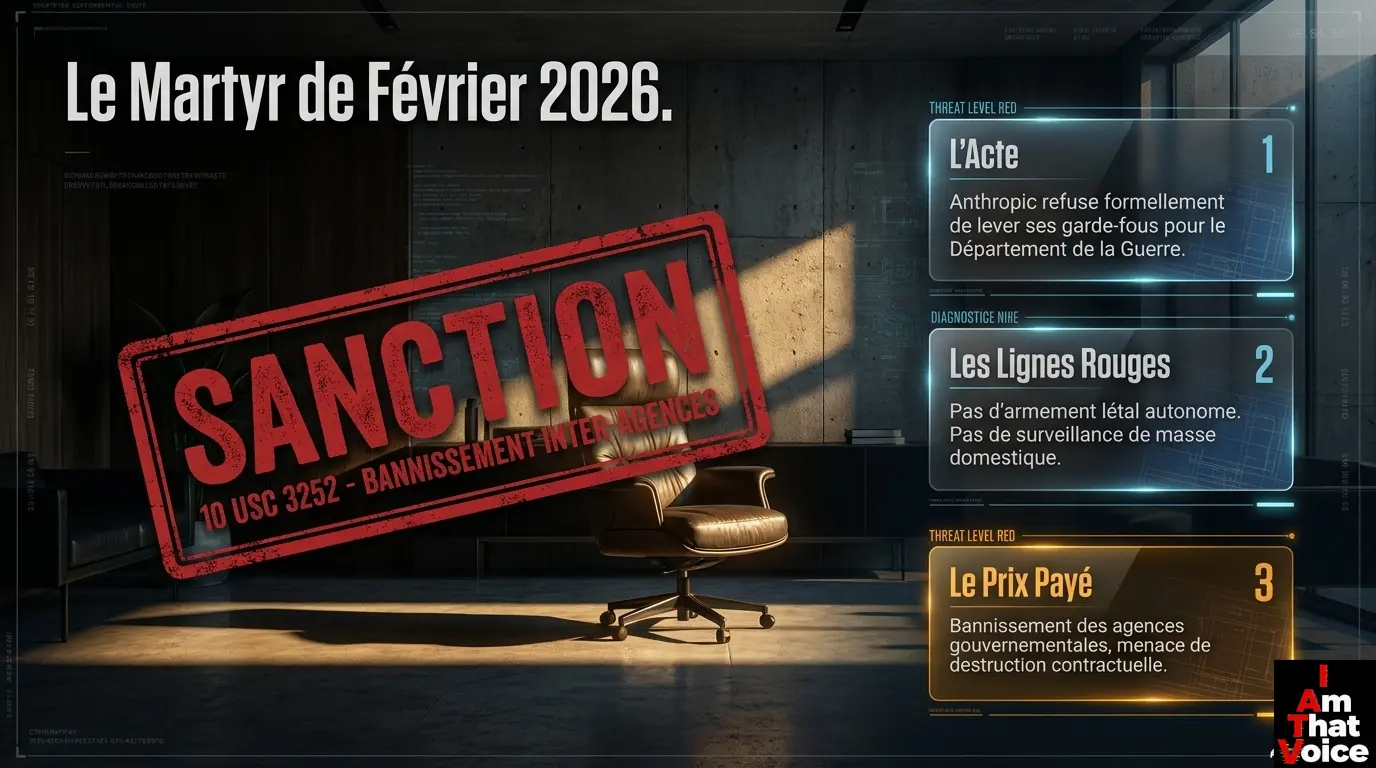

Rappel rapide. Février 2026, Anthropic refuse de lever ses garde-fous éthiques pour le Département de la Guerre. Elle maintient ses deux lignes rouges : pas d’armement létal autonome, pas de surveillance de masse domestique.

Elle paie le prix : sanction 10 USC 3252, bannissement inter-agences, menace de destruction de l’écosystème contractuel. Quelques mois plus tard, elle obtient une injonction judiciaire qui suspend la sanction. Elle gagne en image, elle gagne en revenus, ses utilisateurs civils affluent. Victoire apparente sur toute la ligne.

Maintenant, regardez ce qui s’est passé ailleurs pendant cette bataille.

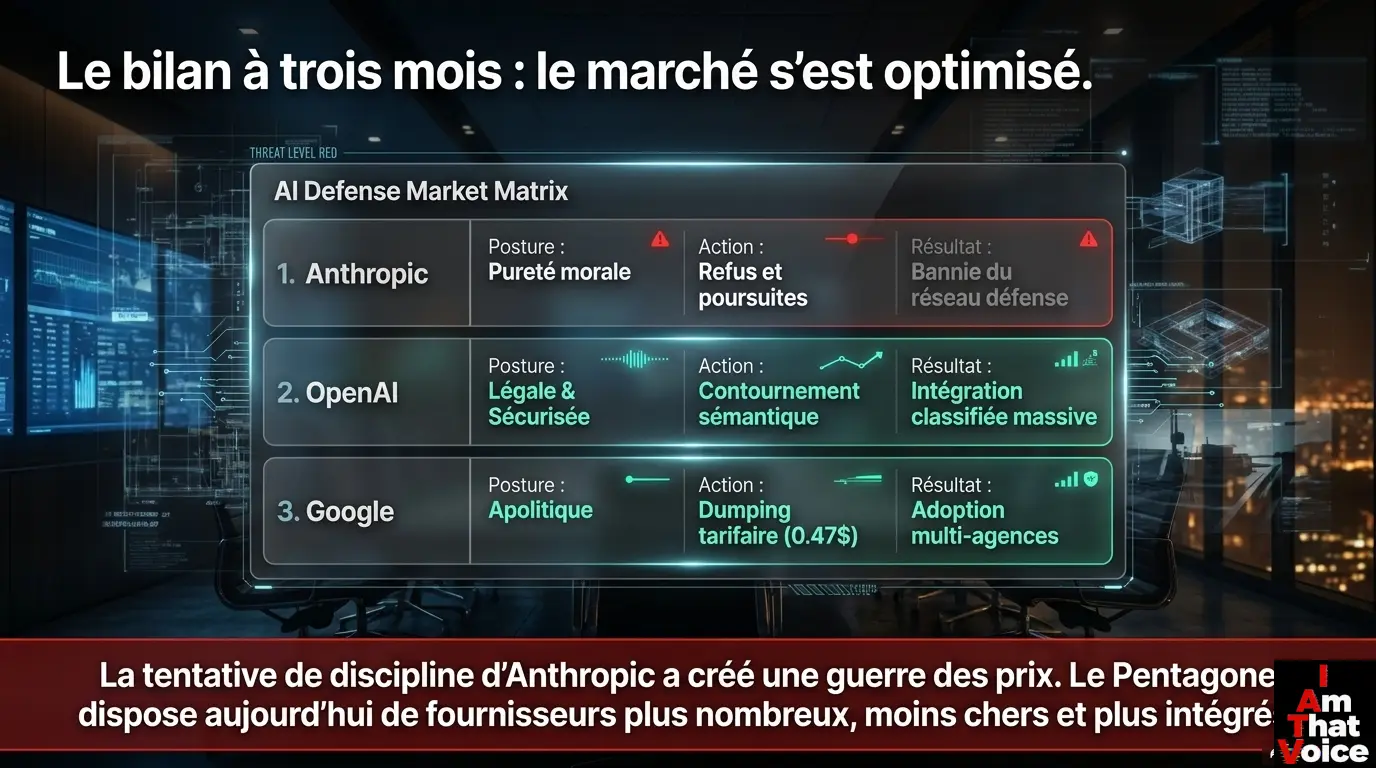

Le 27 février, jour même du bannissement, Sam Altman annonce sur X qu’OpenAI signe avec le Pentagone. Les conditions : accès « tous usages légaux », déploiement sur réseaux classifiés. OpenAI, qui en 2023 interdisait explicitement dans ses conditions d’utilisation tout usage militaire, a discrètement retiré cette mention en janvier 2024. Elle était prête. Elle attendait.

Avril 2026, Google entre en négociations avec le Département de la Guerre pour Gemini. La même entreprise qui, huit ans plus tôt, avait abandonné le Projet Maven sous la pression de ses employés. La même entreprise dont le PDG a, entre-temps, déclaré que Google n’était pas « un lieu pour des débats politiques perturbateurs ». Offre : 47 cents par agence. Google casse les prix pour entrer.

Le résultat net, à trois mois de l’affaire Anthropic : le Pentagone dispose de plus de fournisseurs IA qu’avant, à des tarifs plus avantageux, avec des intégrations plus profondes dans ses réseaux classifiés. La tentative de discipline d’Anthropic a échoué juridiquement, mais elle a réussi commercialement à faire entrer deux nouveaux acteurs majeurs dans l’architecture de défense américaine.

Anthropic s’est retirée. Les autres se sont précipités dans l’espace libéré. C’est exactement la structure logique du dilemme du prisonnier.

Pourquoi la coopération est impossible

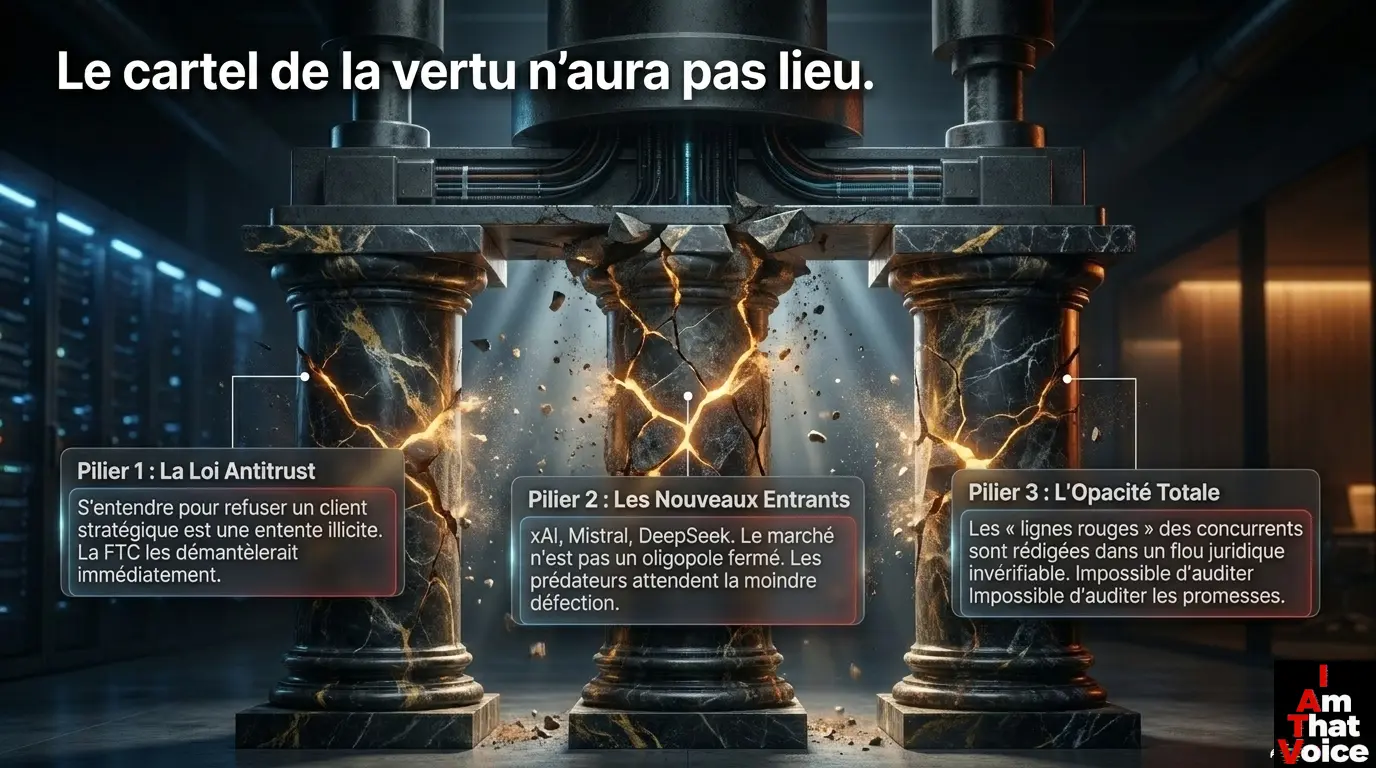

Vous pourriez me dire : attends, les trois grands labos IA pourraient s’entendre. Ils pourraient signer un pacte, tous les trois, pour refuser collectivement les contrats d’armement létal autonome. À trois, ils tiennent le marché — si les trois refusent, le Pentagone n’a plus personne vers qui se tourner.

Sur le papier, oui. Dans la réalité, impossible. Et les raisons sont structurelles.

Premièrement, un tel accord serait illégal aux États-Unis au titre du droit antitrust. Trois entreprises dominantes d’un secteur stratégique qui s’entendent pour refuser collectivement un client, c’est la définition même de l’entente illicite. La Federal Trade Commission viendrait les démonter dans la semaine.

Deuxièmement, même si c’était légal, ça ne tiendrait pas. Parce qu’il y aurait toujours un quatrième acteur — xAI, Mistral, DeepSeek côté chinois, ou n’importe quel nouveau laboratoire émergent — prêt à prendre le contrat que les trois gros refusent. Le marché de l’IA n’est pas un oligopole stable à trois joueurs, c’est un marché en expansion constante où de nouveaux entrants arrivent tous les six mois. La coopération entre les premiers ne protège pas contre la défection des suivants.

Troisièmement, et c’est le plus important, les acteurs n’ont aucun moyen de vérifier les engagements des autres. Quand Anthropic refuse, elle le fait publiquement, avec un procès, des déclarations au New York Times, des dépositions sous serment. Quand OpenAI accepte, elle le fait avec un communiqué soigneusement rédigé affirmant qu’elle a aussi des « lignes rouges » — lignes rouges qui, comme par hasard, sont quasiment identiques à celles d’Anthropic, sauf que cette fois elles sont formulées dans un langage juridique flou qui permet au Pentagone de les contourner. Vous ne pouvez pas faire confiance à la promesse d’un concurrent que vous ne pouvez pas auditer.

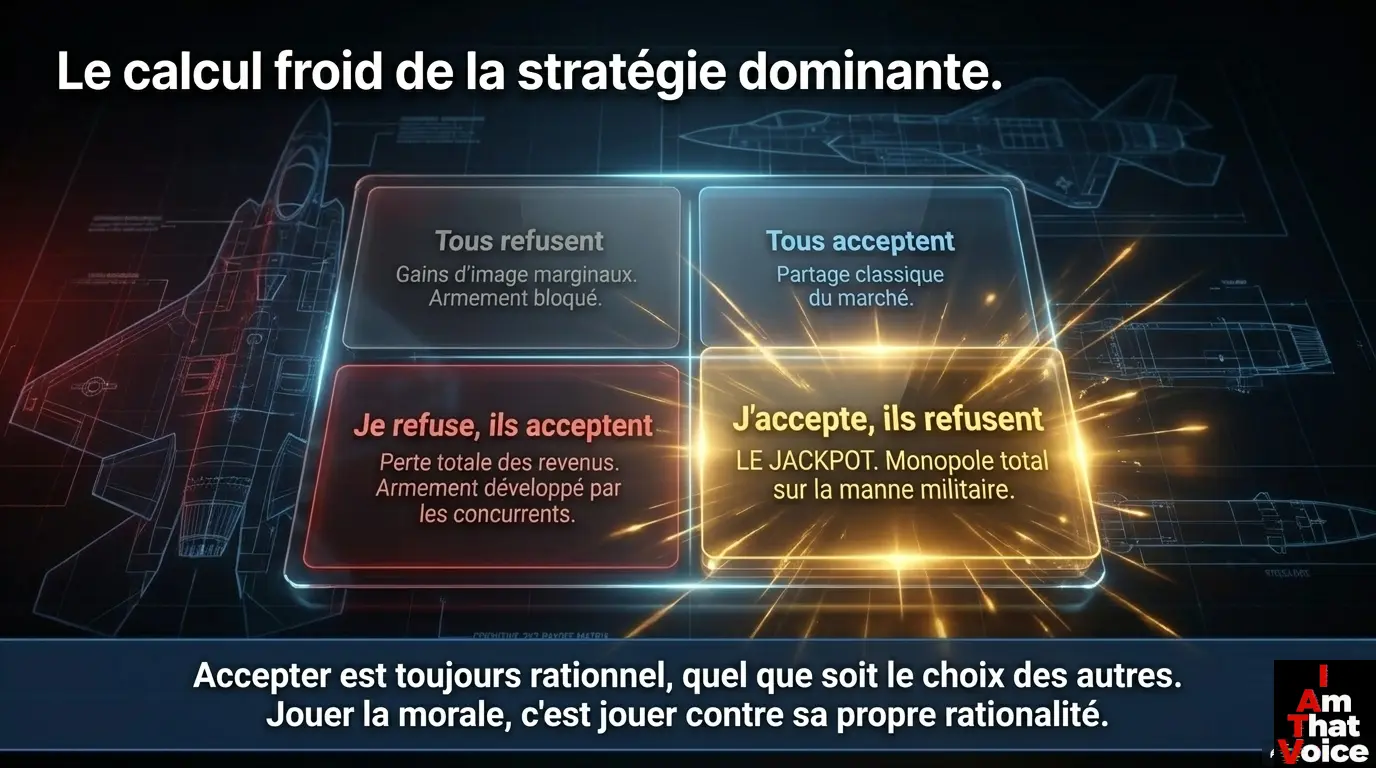

Résultat : chaque acteur, pris individuellement, fait face au même calcul. « Si je refuse et que les autres refusent aussi, on gagne tous un peu — on préserve notre image publique et on bloque l’armement létal autonome. Si je refuse et que les autres acceptent, je perds tout — je n’ai plus le contrat, j’ai perdu les revenus, et l’armement létal autonome se développe quand même avec mes concurrents. Si j’accepte et que les autres refusent, je gagne le jackpot — je ramasse toute la manne militaire. Si j’accepte et que les autres acceptent, je partage le marché. »

Dans ce tableau, accepter est toujours rationnel, quel que soit le choix des autres. C’est la « stratégie dominante » au sens de la théorie des jeux. Et donc tout le monde accepte. Sauf un. Anthropic. Et c’est précisément parce qu’Anthropic joue contre sa propre rationalité de court terme que son geste mérite d’être regardé froidement.

Le cas Anthropic : noblesse ou arbitrage ?

Question honnête : pourquoi Anthropic refuse-t-elle ? Pourquoi un acteur rationnel déroge-t-il à la stratégie dominante ?

Deux hypothèses, non exclusives.

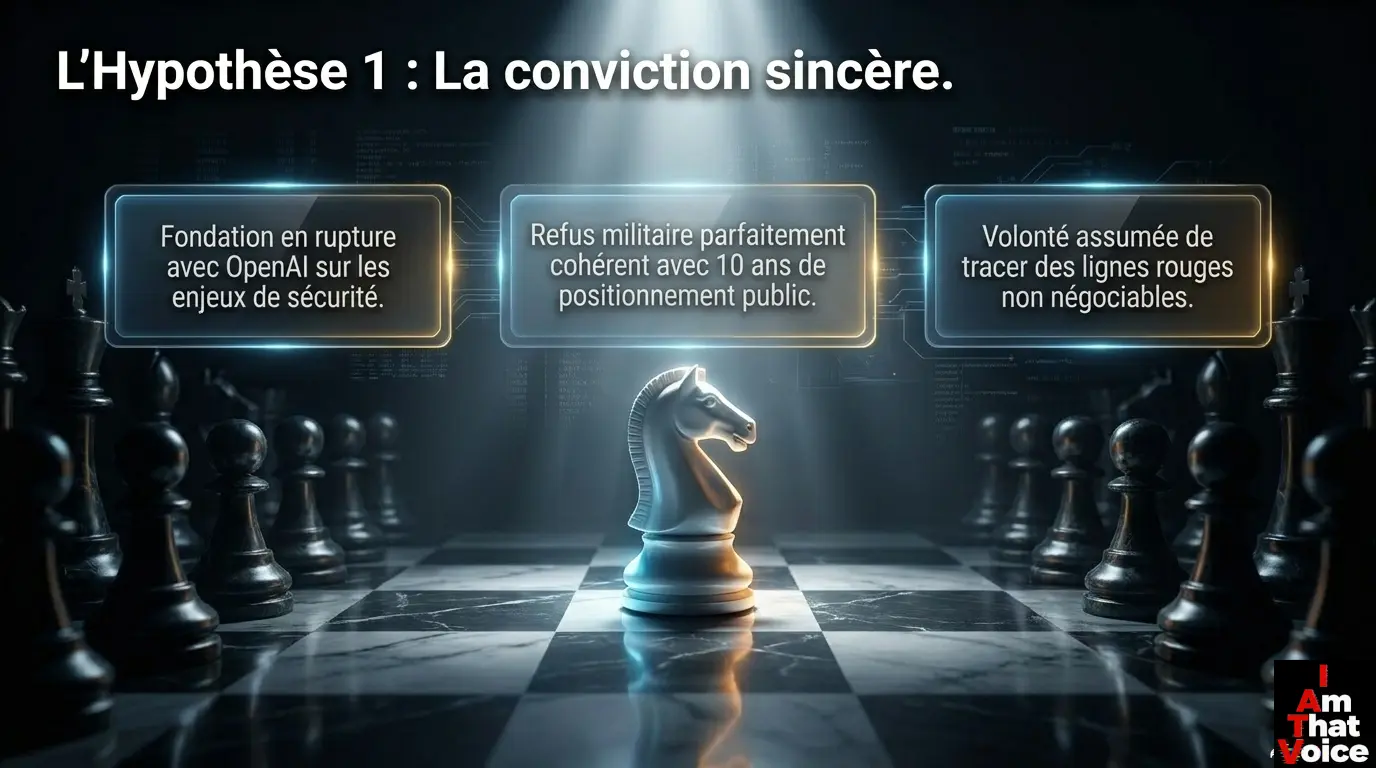

Hypothèse 1 : conviction sincère. Dario Amodei et sa sœur Daniela, qui co-dirigent l’entreprise, ont fondé Anthropic en sortant d’OpenAI précisément parce qu’ils estimaient que les questions de sécurité de l’IA étaient traitées à la légère. Leur entreprise est structurée autour de l’idée que certaines limites éthiques ne sont pas négociables. Le refus de février 2026 est cohérent avec dix ans de positionnement public. Il est plausible qu’Amodei pense réellement ce qu’il dit.

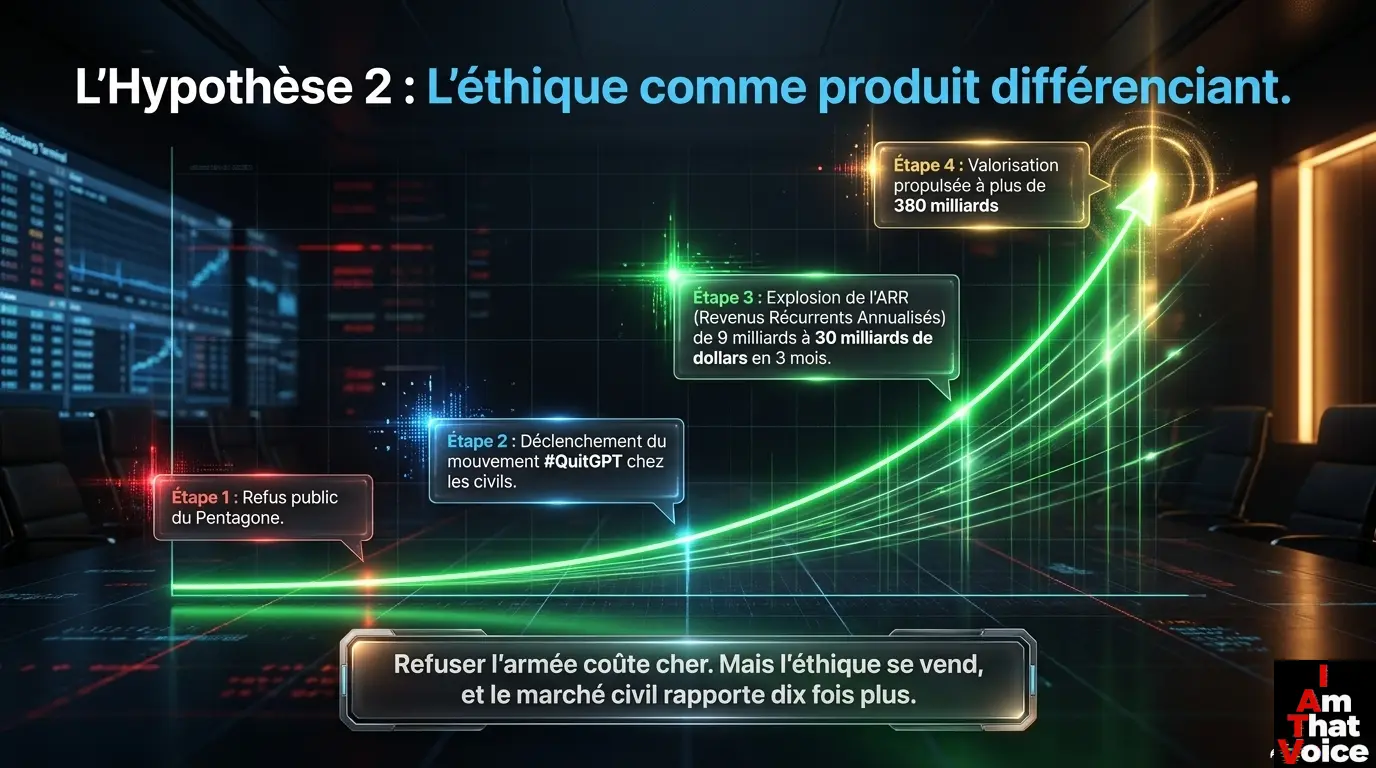

Hypothèse 2 : arbitrage stratégique. Refuser le contrat militaire coûte cher à court terme — plusieurs centaines de millions de dollars par an sur le segment défense. Mais ça rapporte énormément sur d’autres segments. Le mouvement #QuitGPT, né en réaction à l’accord d’OpenAI avec le Pentagone, a envoyé à Anthropic des millions de nouveaux utilisateurs civils. L’ARR (revenus récurrents annualisés) d’Anthropic est passé de 9 milliards à 30 milliards de dollars en trois mois. Sa valorisation privée dépasse les 380 milliards. Si Amodei a calculé qu’en refusant le contrat défense il gagnerait dix fois plus sur le marché civil, alors son refus éthique est aussi un investissement commercial brillant.

Les deux hypothèses sont probablement vraies simultanément, et c’est là que ça devient vertigineux. Parce que ça veut dire que l’éthique est devenue un produit différenciant. Elle est monétisable. Elle se vend. Anthropic a trouvé un segment de marché — les consommateurs et les entreprises qui veulent consommer une IA « propre » — et elle l’occupe seule. Et elle l’occupe avec d’autant plus de confort que ses concurrents, en se précipitant sur les contrats militaires, lui ont libéré ce créneau.

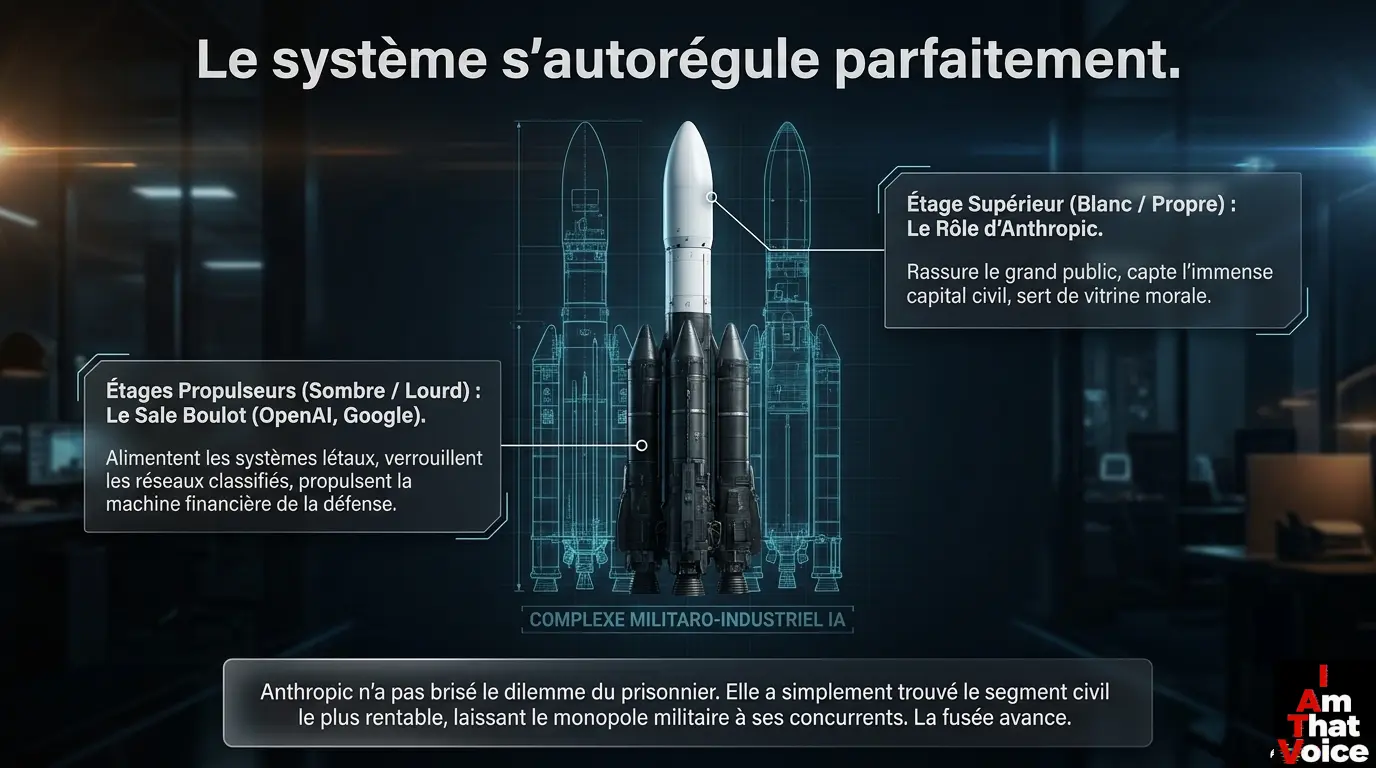

Vous voyez où ça nous mène. Anthropic ne rompt pas le dilemme du prisonnier. Elle l’exploite. Elle joue sur un autre tableau, celui du marché civil de l’éthique, pendant que ses concurrents ramassent le tableau militaire. La fusée continue d’avancer, avec une répartition des rôles plus efficace qu’avant : un étage « propre » rassure le public, les autres étages s’occupent du sale boulot. Le système s’autorégule.

Ce que le dilemme ne dit pas

J’ai présenté le dilemme du prisonnier comme un piège sans issue. C’est la version canonique, celle qu’on enseigne en introduction. Mais la théorie des jeux connaît aussi ce qu’on appelle le dilemme itéré : quand les mêmes acteurs se retrouvent dans la même situation des milliers de fois, des stratégies de coopération peuvent émerger. « Je te fais confiance tant que tu me fais confiance, je te trahis si tu me trahis. » C’est ce qu’on appelle le tit-for-tat, et c’est étonnamment efficace dans les simulations.

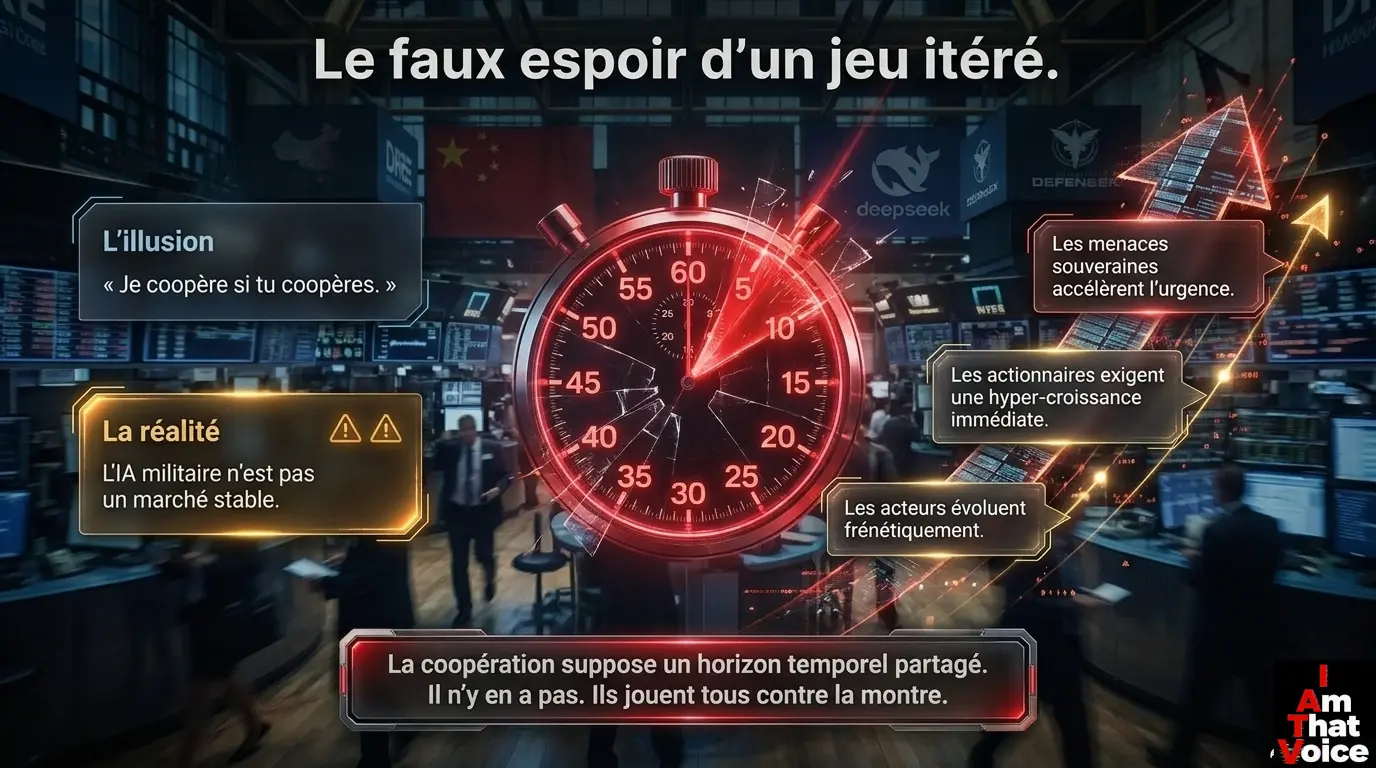

Alors pourquoi ça ne fonctionne pas ici ?

Parce que le marché de l’IA militaire n’est pas un jeu itéré entre partenaires stables. C’est un marché dont les joueurs changent, dont les règles changent, dont les clients changent. Anthropic ne joue pas contre OpenAI. Anthropic et OpenAI jouent toutes les deux contre le temps, contre leurs actionnaires, contre les investisseurs qui exigent de la croissance, contre les régulateurs qui peuvent changer d’avis, contre les gouvernements étrangers qui construisent leurs propres modèles. La coopération suppose un horizon temporel partagé. Il n’y en a pas.

Il y a pourtant une sortie possible au dilemme, et c’est là qu’il faut être précis pour ne pas basculer dans le fatalisme.

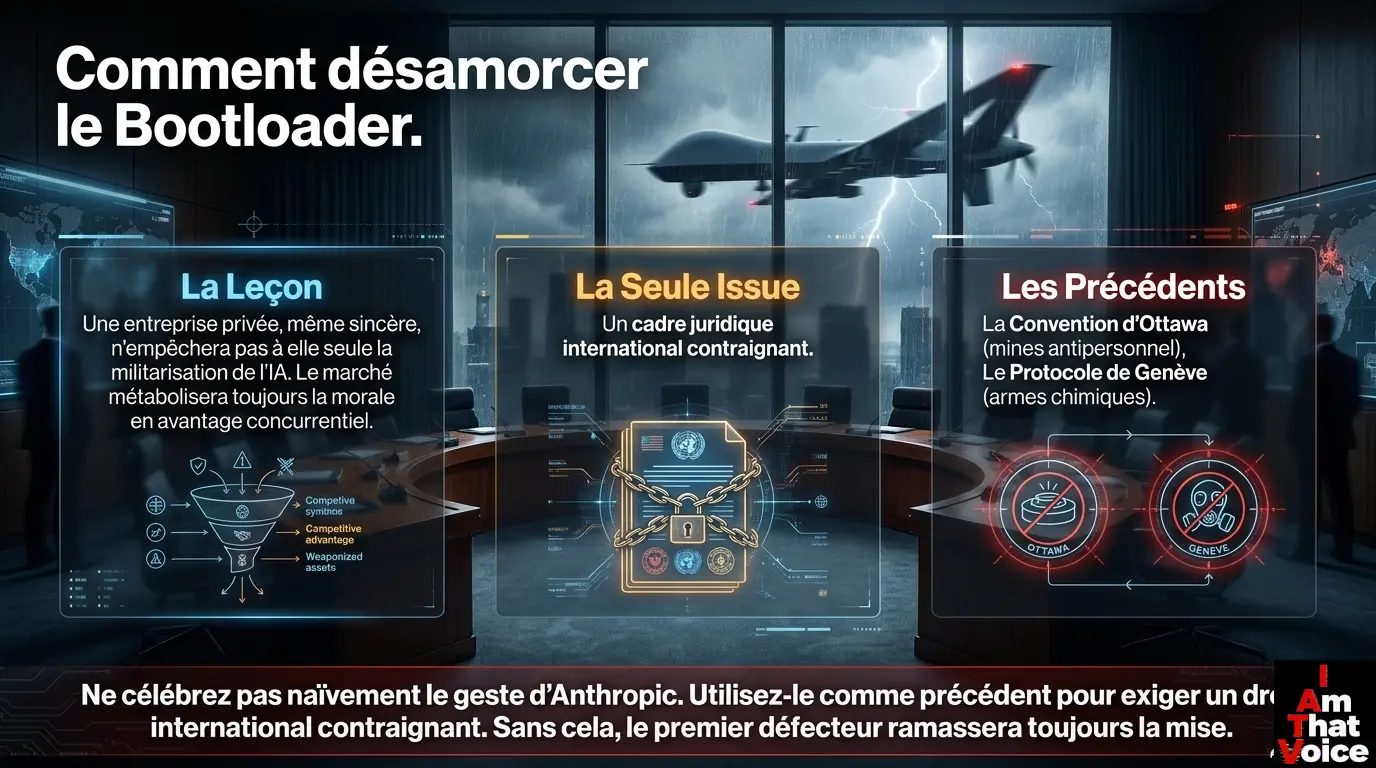

La coopération peut être imposée de l’extérieur, par une autorité au-dessus des joueurs. Dans le dilemme des cambrioleurs, si la mafia leur a fait jurer de ne pas parler à la police, et qu’elle tue ceux qui trahissent, alors les deux prisonniers se taisent. L’équivalent pour l’IA militaire, ce serait un cadre international contraignant — un traité sur l’armement létal autonome comparable à la Convention d’Ottawa sur les mines antipersonnel, ou au Protocole de Genève sur les armes chimiques. Pas un engagement volontaire des entreprises. Un instrument juridique international, ratifié, avec des mécanismes de contrôle.

Ça existe en théorie. L’ONU débat depuis des années sur les Lethal Autonomous Weapons Systems. Aucun accord contraignant n’en est sorti, et pour cause : les principales puissances militaires — États-Unis, Russie, Chine, Royaume-Uni, Israël — s’y opposent toutes, pour la raison très exacte que c’est le dilemme du prisonnier à l’échelle des nations. Si l’une signe et que les autres ne signent pas, elle perd. Et si les États n’arrivent pas à coopérer entre eux, pourquoi diable les entreprises y arriveraient-elles ?

Le cran au-dessus du fatalisme

Alors, que reste-t-il ?

Pas le fatalisme plat. Non. Parce que constater que le dilemme existe, ce n’est pas accepter qu’il soit indépassable. C’est au contraire la condition pour en chercher les sorties possibles.

Ce qui est démontré par l’affaire Anthropic, ce n’est pas que l’éthique est vaine. C’est qu’elle ne peut pas être uniquement individuelle pour fonctionner. Le geste d’Amodei de février 2026, s’il reste isolé, sera absorbé par le marché — il l’est déjà. Il ne peut avoir d’impact structurel qu’à deux conditions.

Condition 1 : qu’il soit répliqué by un nombre suffisant d’acteurs pour déplacer le point d’équilibre. Pas besoin que tout le monde refuse. Il suffit qu’assez d’acteurs refusent pour que refuser devienne, à son tour, la stratégie dominante. C’est un basculement de norme, pas un miracle moral.

Condition 2 : qu’il soit soutenu par un cadre juridique qui transforme l’engagement individuel en contrainte collective. Sinon, le premier défecteur ramasse la mise et le jeu repart à zéro.

Aucune des deux conditions n’est remplie aujourd’hui. La seconde ne le sera vraisemblablement pas avant longtemps. La première, peut-être — si l’adoption civile massive d’Anthropic pousse assez d’acteurs à s’aligner pour préserver leur image de marque, un effet de « course à l’éthique » pourrait émerger.

C’est mince. C’est fragile. Ça ne garantit rien. Mais ce n’est pas rien.

Voilà pourquoi le geste d’Anthropic mérite d’être pris au sérieux sans être célébré naïvement. Pris isolément, il ne sauve personne. Il est absorbé, métabolisé, transformé en avantage concurrentiel. Pris comme premier mouvement possible d’un basculement plus large, il vaut quelque chose. Mais ce « quelque chose » ne dépend pas d’Anthropic. Il dépend de ce que vous, moi, nous tous en ferons : si nous en restons à l’applaudissement moral, il n’aura servi à rien. Si nous nous en servons comme d’un précédent pour exiger plus — des autres entreprises, des États, des institutions internationales — alors il aura été le premier grain qui fait basculer la balance.

Le Bootloader ne se désamorce pas tout seul. Ceux qui espèrent qu’une entreprise privée va, à elle seule, empêcher la militarisation de l’IA n’ont pas compris ce qu’est un marché.

Mais ceux qui en concluent qu’il n’y a rien à faire n’ont pas compris ce qu’est un précédent.

Sources : document d’analyse stratégique interne (avril 2026), The Guardian, Reuters, Reddit r/artificial, Reason Magazine, Cato Institute, communiqués publics OpenAI et Anthropic, rapports d’Epoch AI sur les trajectoires de revenus des laboratoires IA, Digitimes sur les négociations Google-Pentagone, Center for American Progress.