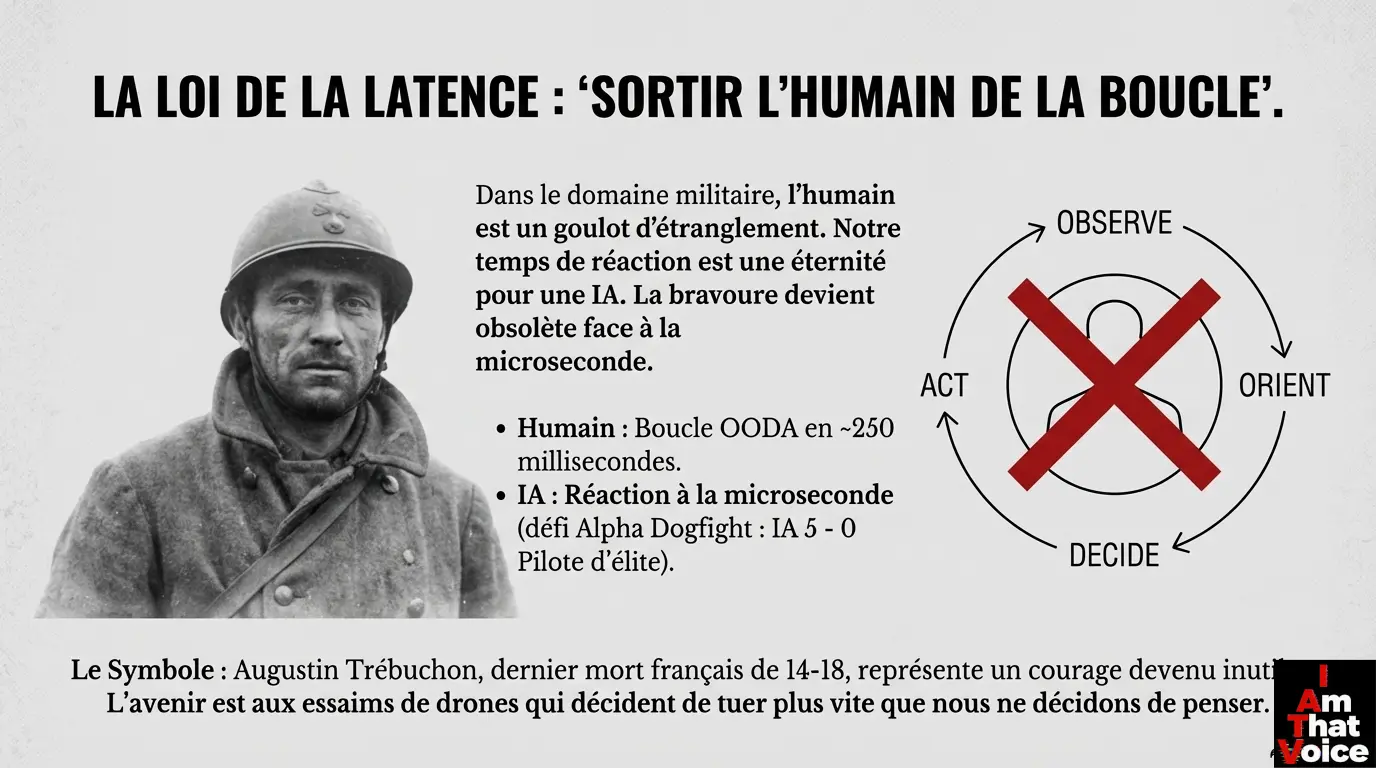

Tout ce que Cassandria a publié jusqu’ici — l’obsolescence du soldat, l’État abonné, la bravoure rendue impossible, la guerre asymétrique de l’open source — pourrait laisser une impression de fatalité implacable. Le Golem d’un côté, le Léviathan de l’autre. L’humain broyé entre les deux.

Cette impression est compréhensible. Elle est aussi partiellement fausse.

Non pas parce que la situation n’est pas grave — elle l’est. Mais parce qu’une troisième voie existe réellement, documentée, techniquement émergente, portée par des acteurs concrets dans des lieux identifiables. Elle n’est pas hégémonique. Elle n’a pas les milliards des GAFAM ni l’appareil d’État de Pékin. Mais elle existe. Et comprendre pourquoi elle échoue à s’imposer est aussi important que de comprendre pourquoi elle mérite d’être construite.

Le Faux Dilemme

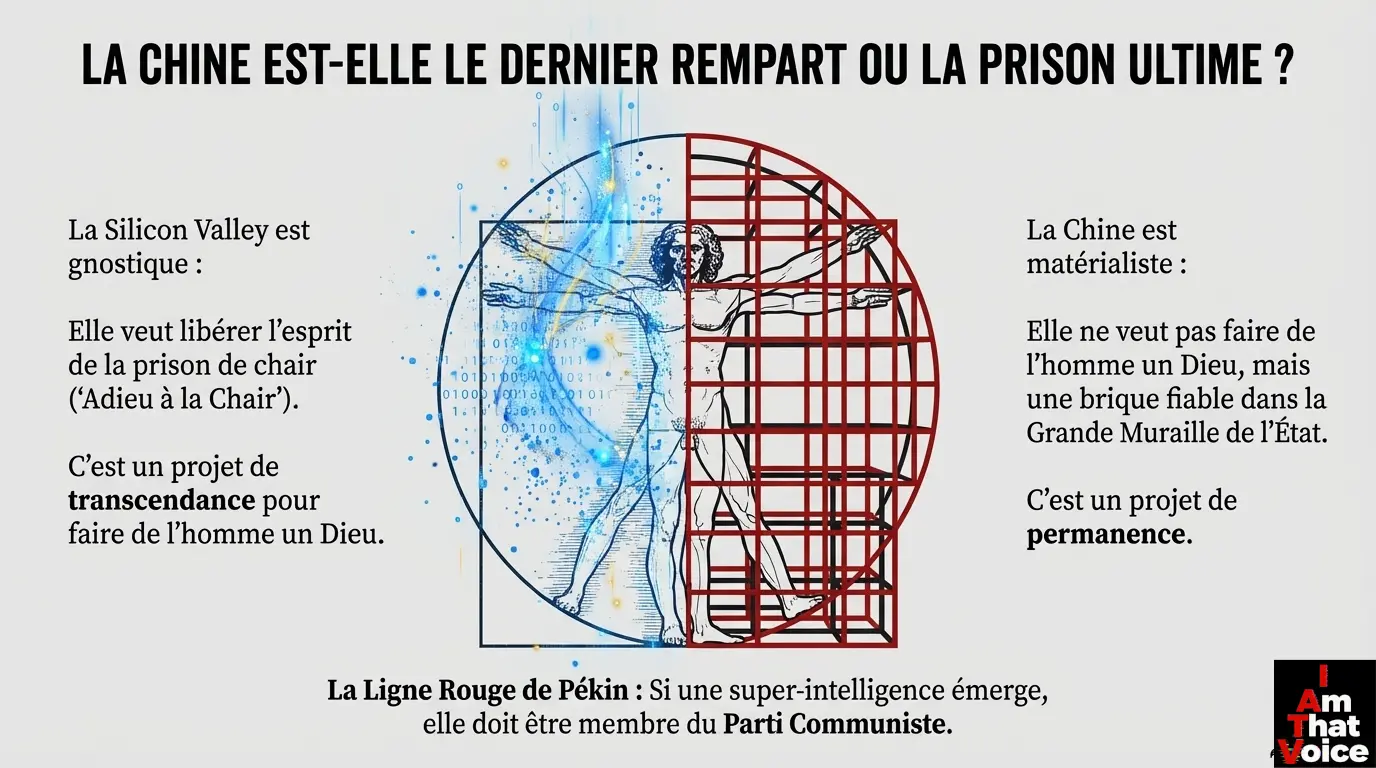

La narration dominante présente la question de l’IA comme un choix binaire : soit vous utilisez les services d’OpenAI/Google/Meta (efficaces, pratiques, et soumis à la juridiction américaine), soit vous devenez une province numérique du Léviathan chinois.

Ce dilemme est une construction. Il sert les intérêts des deux pôles dominants — américain comme chinois — parce qu’il élimine intellectuellement la possibilité d’une alternative avant même qu’elle ne soit considérée.

Le système vTaiwan, développé sous l’impulsion de la ministre du Numérique Audrey Tang, utilise l’outil open source Polis pour faciliter la délibération citoyenne. Il a permis à Taïwan de légiférer sur des sujets complexes — comme la régulation d’Uber — avec un niveau de légitimité démocratique sans précédent.

Le système vTaiwan, développé sous l’impulsion de la ministre du Numérique Audrey Tang, utilise l’outil open source Polis pour faciliter la délibération citoyenne. Il a permis à Taïwan de légiférer sur des sujets complexes — comme la régulation d’Uber — avec un niveau de légitimité démocratique sans précédent.

La troisième voie se construit à l’intersection de trois mouvements distincts mais convergents : une alternative technique (l’IA décentralisée), une alternative politique (la gouvernance démocratique de l’IA), et une alternative géopolitique (l’IA comme bien public souverain).

La Voie Technique : Briser le Monopole du Data Center

La première objection à une IA souveraine est toujours matérielle : entraîner un modèle de fondation compétitif nécessite des milliers de GPU H100, des data centers dévorant des centaines de mégawatts, et des investissements de plusieurs milliards de dollars. Seules quelques entités dans le monde en sont capables.

Cette objection était valide jusqu’en 2024. Elle ne l’est plus tout à fait.

L’algorithme DiLoCo (Distributed Low-Communication), développé par Google DeepMind et mis en œuvre par des organisations comme Prime Intellect, a changé la donne. Au lieu de nécessiter des GPU synchronisés en permanence par des câbles ultra-rapides, DiLoCo permet à des GPU dispersés dans le monde entier de s’entraîner indépendamment pendant des centaines d’étapes avant de synchroniser leurs résultats.

BLOOM (176 milliards de paramètres) a été entraîné sur le supercalculateur public Jean Zay, en France, par le consortium BigScience regroupant 1 000 chercheurs de 60 pays. La première preuve que la puissance publique peut produire un modèle de fondation compétitif.

BLOOM (176 milliards de paramètres) a été entraîné sur le supercalculateur public Jean Zay, en France, par le consortium BigScience regroupant 1 000 chercheurs de 60 pays. La première preuve que la puissance publique peut produire un modèle de fondation compétitif.

La réduction des besoins en communication est un facteur 500 à 4 000 selon les configurations. Ce qui signifie concrètement qu’il devient possible de connecter un laboratoire universitaire à Lyon, un centre de données en Islande, et des volontaires au Brésil via une connexion Internet standard pour entraîner collectivement un modèle géant.

Fin 2024, Prime Intellect a prouvé la viabilité de cette approche en entraînant INTELLECT-1 — 10 milliards de paramètres — sur une architecture décentralisée s’étendant sur trois continents. Ce n’est pas encore GPT-4. Mais c’est la preuve de concept qui change la nature du problème : le monopole de l’entraînement n’est plus une fatalité physique. C’est une question de coordination économique.

La réduction des besoins en communication réseau permise par DiLoCo. Une révolution technique qui rend possible l'entraînement distribué de modèles géants sans infrastructure centralisée.

Le projet Petals, né du consortium BigScience qui a produit le modèle BLOOM, va plus loin encore : il permet de faire tourner des modèles de classe mondiale sur du matériel grand public (des cartes graphiques de jeu vidéo) en distribuant les couches du modèle entre des pairs connectés — comme BitTorrent, mais pour l’inférence IA.

La Voie Politique : vTaiwan et la Démocratie Algorithmique

La décentralisation technique ne suffit pas. Une IA distribuée sans gouvernance démocratique pourrait simplement devenir un chaos capturé par des acteurs malveillants. La vraie rupture se joue dans la gouvernance.

Taïwan offre le modèle le plus abouti à ce jour. Sous l’impulsion d’Audrey Tang, ancienne ministre du Numérique, le pays a développé un système de délibération citoyenne appelé vTaiwan, utilisant l’outil open source Polis.

Polis fonctionne à rebours des réseaux sociaux occidentaux. Là où Facebook et Twitter maximisent l’engagement par la division — les commentaires polémiques génèrent 5 fois plus d’engagement que les contenus constructifs — Polis utilise l’apprentissage automatique pour identifier les déclarations qui recueillent l’assentiment entre des groupes d’opinion opposés. Il rend visible le consensus là où les algorithmes de recommandation habituels ne montrent que le conflit.

Mistral AI, startup française, incarne la troisième voie par sa stratégie Open Weights : publier des modèles ouverts que tout le monde peut auditer, modifier et déployer localement, tout en refusant la domination culturelle anglo-saxonne des modèles américains.

Mistral AI, startup française, incarne la troisième voie par sa stratégie Open Weights : publier des modèles ouverts que tout le monde peut auditer, modifier et déployer localement, tout en refusant la domination culturelle anglo-saxonne des modèles américains.

Le résultat : Taïwan a utilisé vTaiwan pour légiférer sur des sujets épineux comme la régulation d’Uber, la vente d’alcool en ligne, ou les droits des travailleurs de plateforme — avec un niveau de légitimité démocratique que les processus parlementaires classiques peinent à atteindre.

Ce n’est pas de l’utopie. C’est du logiciel open source, déployable demain, dont le code est public et auditable.

La Voie Géopolitique : Le CERN pour l’IA

Au-delà des acteurs privés et des expérimentations citoyennes, des États commencent à tracer une troisième voie géopolitique.

La France soutient Mistral AI — non pas comme une startup parmi d’autres, mais comme un choix stratégique de souveraineté. Le président Macron a explicitement cadré cette stratégie comme une voie d’indépendance pour l’Europe. Mistral incarne la troisième voie par son adhésion à l’Open Weights : publier les poids des modèles permet à tout État, toute université, toute entreprise de les déployer localement, sans dépendance à un serveur central, sans Cloud Act applicable.

Le nombre de paramètres de BLOOM, entraîné sur Jean Zay (IDRIS, France) par 1 000 chercheurs de 60 pays. Premier grand modèle multilingue ouvert — preuve que la puissance publique peut rivaliser avec les GAFAM.

La proposition la plus structurante, soutenue par plusieurs rapports stratégiques européens, est la création d’un CERN pour l’IA : une infrastructure de recherche transnationale publique sur le modèle du CERN nucléaire de Genève. L’idée est simple dans son principe : traiter l’intelligence artificielle comme un bien public scientifique plutôt que comme une marchandise privée. Produire des modèles de fondation ouverts, sûrs, alignés sur des valeurs démocratiques délibérées collectivement.

L’Inde propose peut-être le modèle étatique le plus cohérent. Après le succès de son India Stack — identité numérique Aadhaar, paiements UPI — l’Inde envisage l’IA comme une infrastructure publique numérique. L’État fournit les “rails” (données souveraines, compute accessible), sur lesquels le secteur privé peut innover. Ce modèle empêche la capture de valeur par des monopoles étrangers tout en stimulant l’innovation locale.

La Data Dignity : Reprendre la Propriété de Son Intelligence

La proposition la plus radicale vient de Jaron Lanier, pionnier de la réalité virtuelle et critique acéré de l’économie de la surveillance.

Son concept de Data Dignity part d’un constat simple : les modèles d’IA sont entraînés sur des données produites par des milliards d’humains — leurs textes, leurs images, leurs conversations, leurs œuvres. Dans le modèle centralisé actuel, ces données sont aspirées gratuitement. Les humains produisent la matière première de l’intelligence artificielle sans aucune compensation.

Le concept de Data Dignity de Jaron Lanier : si les modèles d’IA sont entraînés sur nos données, nous devrions être rémunérés pour chaque utilisation de notre contribution. L’IA comme levier de prospérité partagée plutôt que de concentration des richesses.

Le concept de Data Dignity de Jaron Lanier : si les modèles d’IA sont entraînés sur nos données, nous devrions être rémunérés pour chaque utilisation de notre contribution. L’IA comme levier de prospérité partagée plutôt que de concentration des richesses.

Dans un modèle décentralisé et crypto-économique, il devient techniquement possible de tracer la contribution de chaque donnée et de rémunérer son créateur pour chaque utilisation. L’IA ne serait plus un mécanisme de concentration des richesses — elle deviendrait un levier de prospérité partagée.

Ce n’est pas encore déployé à grande échelle. Mais Bittensor, protocole décentralisé pour l’intelligence machine, explore précisément cette voie : créer un marché où les contributeurs d’IA (que ce soit du compute, des données ou des modèles) sont rémunérés pour la valeur cognitive qu’ils produisent.

Pourquoi la Troisième Voie Peine à S’Imposer

Si tout cela existe — techniques, expérimentations politiques, initiatives souveraines — pourquoi le monde bascule-t-il quand même vers le duopole ?

Parce que la troisième voie est structurellement désavantagée par les économies d’échelle. Un modèle centralisé avec 10 milliards de dollars de compute produit aujourd’hui un modèle meilleur qu’une coalition distribuée avec 100 millions. L’avantage du capital concentré est réel et massif à court terme.

Parce que la commodité crée de la dépendance. ChatGPT est disponible en 30 secondes, fonctionne immédiatement, et est intégré dans tous les outils existants. Déployer un modèle Mistral en local exige des compétences techniques, du matériel, du temps. La frictionlessness du Golem est une arme.

Parce que la gouvernance démocratique est lente. vTaiwan prend des semaines. Un conseil d’administration californien décide en une heure. Dans un monde où la vitesse est une arme, la délibération ressemble à une faiblesse.

La troisième voie traite l’humain comme un architecte de son futur technologique — non comme un substrat obsolète ou une variable à administrer. C’est la seule des trois visions qui préserve l’agence humaine.

La troisième voie traite l’humain comme un architecte de son futur technologique — non comme un substrat obsolète ou une variable à administrer. C’est la seule des trois visions qui préserve l’agence humaine.

Mais ces désavantages ne sont pas des fatalités. Ce sont des problèmes de coordination économique et politique — solubles si la volonté collective existe.

Ce qui est en Jeu

Daron Acemoglu, Prix Nobel d’économie, et Simon Johnson ont argumenté dans Power and Progress que la direction actuelle de l’IA — remplacement de l’humain, concentration du pouvoir, automatisation maximale — n’est pas une fatalité technologique. C’est un choix institutionnel.

La technologie ne détermine pas son propre usage. Ce sont les institutions, les lois, les structures de gouvernance, et en dernière instance les citoyens, qui décident si une technologie sert l’augmentation humaine ou le remplacement humain.

La troisième voie est la seule qui traite l’être humain comme un architecte de son futur technologique — non comme un Bootloader à effacer une fois la machine initialisée, non comme une variable à administrer dans un crédit social.

Elle est imparfaite. Elle est lente. Elle est sous-financée. Mais elle est réelle. Et la différence entre un monde où elle existe comme contre-pouvoir et un monde où elle a disparu faute d’avoir été construite — cette différence-là est peut-être la définition même de la civilisation.