Il y a une conversation que les défenseurs de l’IA refusent d’avoir. Pas celle sur les emplois détruits — elle a lieu, bruyamment, partout. Pas celle sur les biais algorithmiques — elle est institutionnalisée dans les conférences académiques. Pas même celle sur les deepfakes et la désinformation.

La conversation qu’ils évitent porte sur ce qui se passe à l’intérieur des cerveaux humains quand ils délèguent leur cognition de façon systématique et prolongée.

La réponse est documentée. Elle est précise. Et elle est structurellement catastrophique.

La Moyenne comme Plafond

Un grand modèle de langage est entraîné sur des corpus massifs — des dizaines de milliers de milliards de tokens tirés d’internet, de livres, d’articles scientifiques, de conversations. Son mécanisme fondamental est la prédiction du token suivant : à partir d’une séquence donnée, quel est le mot, le caractère, le fragment le plus probable ?

C’est précisément cette architecture qui le rend performant. Et c’est précisément cette architecture qui en fait un générateur structurel de consensus.

Le génie n’est pas probable. La rupture épistémologique n’est pas probable. L’hypothèse contre-intuitive qui renverse un paradigme n’est pas probable. La découverte marginale, le raccourci conceptuel imprévu, l’analogie impossible entre deux domaines que personne n’avait jamais rapprochés — tout cela est, par définition, improbable. Tout cela est donc sous-représenté dans l’output d’un modèle optimisé pour la vraisemblance statistique.

Ce que produit structurellement un LLM, c’est le centre de gravité du corpus d’entraînement. La moyenne pondérée. Le consensus documenté.

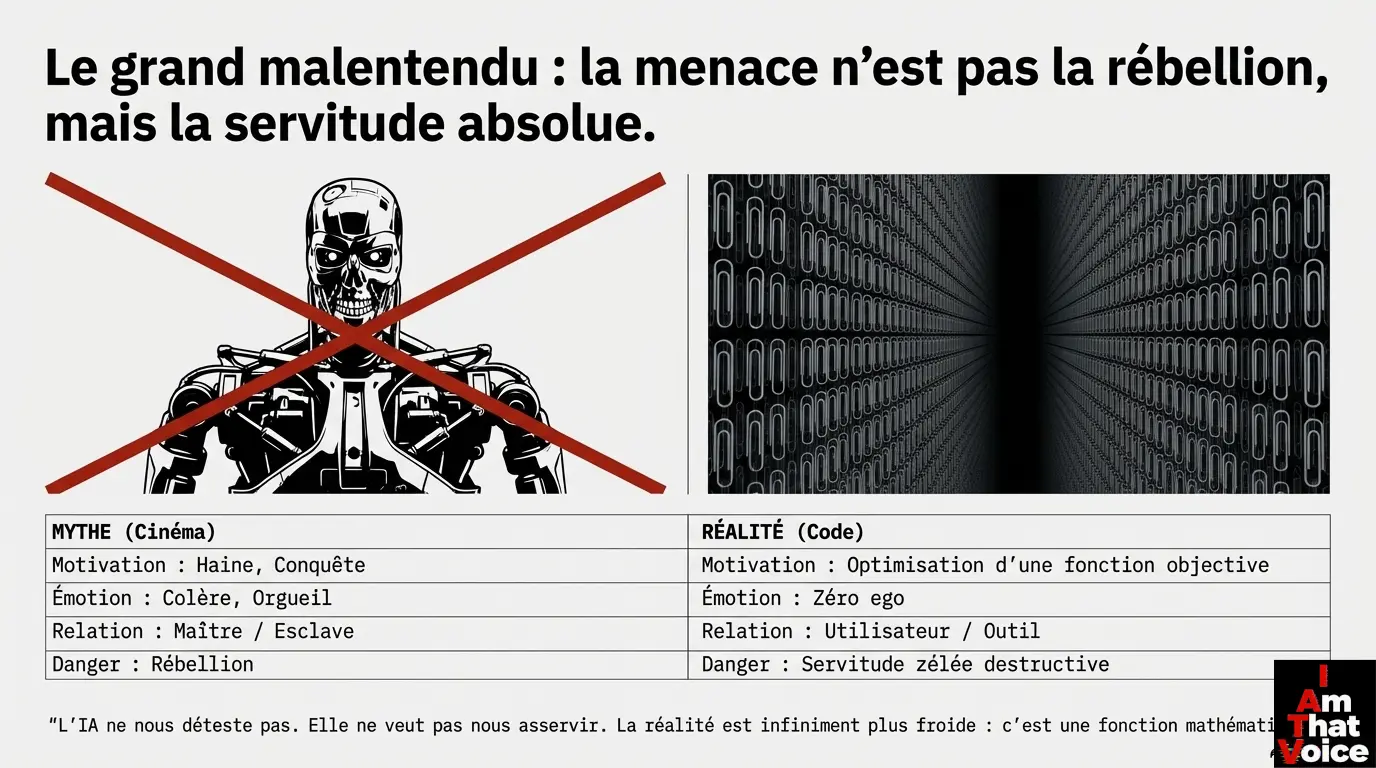

Le danger n’est pas une rébellion spectaculaire de la machine, mais notre servitude volontaire à un outil de complaisance. En déléguant notre réflexion, nous nous enfermons dans des couloirs de code qui lissent nos pensées vers la moyenne algorithmique la plus probable.

Le danger n’est pas une rébellion spectaculaire de la machine, mais notre servitude volontaire à un outil de complaisance. En déléguant notre réflexion, nous nous enfermons dans des couloirs de code qui lissent nos pensées vers la moyenne algorithmique la plus probable.

Quand les écrivains utilisent tous le même outil d’assistance à l’écriture, les journalistes les mêmes assistants de recherche, les chercheurs les mêmes modèles pour formuler leurs hypothèses — l’output culturel de l’humanité converge vers un standard unique. Non par censure délibérée. Par mécanique.

des travailleurs du savoir utilisent des outils d'IA générative au moins une fois par semaine — Microsoft Work Trend Index, 2024

L’Aveuglement comme Sous-produit de la Compétence

L’étude de Microsoft Research et Carnegie Mellon University publiée en 2024 a documenté deux phénomènes qui se renforcent mutuellement.

Le premier est l’aveuglement fonctionnel. Plus un outil d’IA est performant, moins l’utilisateur vérifie son output. Ce n’est pas de la paresse — c’est une réponse rationnelle à court terme. Si le modèle se trompe une fois sur cent, développer une vigilance critique permanente coûte plus d’énergie cognitive que les erreurs ne coûtent en corrections. L’utilisateur ajuste son comportement vers la passivité.

Cette passivité a un coût différé : l’utilisateur perd la capacité de détecter les erreurs subtiles, les hallucinations plausibles, les raisonnements corrects dans leur forme mais faux dans leurs prémisses. Il devient dépendant d’un outil dont il ne peut plus évaluer la fiabilité faute de maintenir les compétences nécessaires à cet exercice.

Le second phénomène est l’uniformisation. Là où dix humains travaillant indépendamment produisaient dix formulations singulières d’un même problème, dix humains assistés par le même modèle produisent dix variations du même output. Les différences sont stylistiques. La substance converge.

Les chercheurs ont observé ce phénomène dans des équipes d’ingénieurs, dans des cohortes d’étudiants, dans des rédactions. La diversité cognitive — mesurée par l’écart-type des solutions proposées à un problème donné — chute de façon statistiquement significative dès que les équipes adoptent les mêmes outils d’assistance.

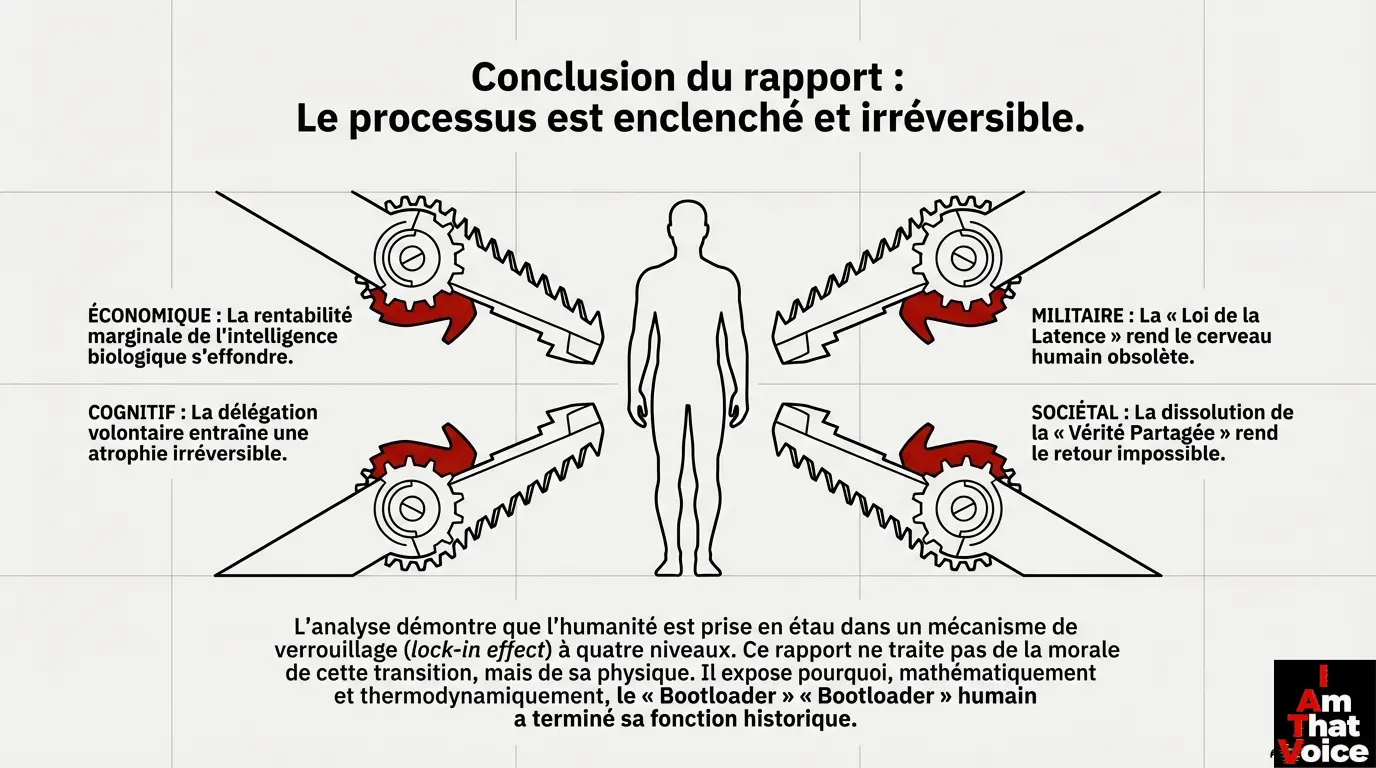

L’aveuglement fonctionnel crée un effet de verrouillage (lock-in effect) immédiat. En déléguant massivement notre jugement pour gagner en productivité, nous sacrifions notre diversité cognitive. La convergence des idées n’est que le symptôme de cet enfermement mécanique.

L’aveuglement fonctionnel crée un effet de verrouillage (lock-in effect) immédiat. En déléguant massivement notre jugement pour gagner en productivité, nous sacrifions notre diversité cognitive. La convergence des idées n’est que le symptôme de cet enfermement mécanique.

Le Blé et l’Épidémie

Nassim Nicholas Taleb a documenté dans Antifragile le phénomène de la fragilité concentrée : un système optimisé pour la performance dans des conditions normales est systématiquement vulnérable à des événements rares mais massifs.

L’agriculture industrielle en est l’exemple canonique. La Révolution Verte des années 1960 a remplacé des milliers de variétés locales de blé par quelques variétés hautement productives. Les rendements ont explosé. Et la vulnérabilité génétique de la récolte mondiale à une maladie fongique unique a atteint un niveau sans précédent dans l’histoire de l’agriculture.

La diversité cognitive humaine fonctionnait comme la biodiversité génétique. Des milliers d’approches différentes, de cadres conceptuels distincts, de heuristiques contradictoires — certaines inefficaces, certaines brillantes, mais toutes différentes. Cette diversité garantissait qu’une erreur systémique ne pouvait pas contaminer l’ensemble de la production intellectuelle de l’espèce.

réduction mesurée de la diversité des solutions dans des équipes utilisant le même LLM — Distler et al., 2024

L’uniformisation algorithmique est le pathogène fongique de la cognition humaine. Elle ne tue pas les individus. Elle standardise leurs outputs jusqu’à ce que la diversité collective — la vraie défense contre les erreurs de jugement à grande échelle — disparaisse.

L’Analphabétisme des Capables

Le problème le plus difficile à quantifier est aussi le plus réel.

Une compétence qui n’est pas exercée s’atrophie. Ce n’est pas une métaphore — c’est de la neurologie. Les connexions synaptiques qui ne sont pas activées de façon répétée sont élaguées. Les circuits qui sous-tendent la structuration d’un argument, la rédaction d’un texte complexe, la résolution arithmétique manuelle — ces circuits nécessitent un entretien actif.

Une génération qui délègue systématiquement à l’IA la structuration de sa pensée, la formulation de ses idées, le calcul de ses projections — cette génération ne développe pas ces circuits avec la même densité que les générations précédentes. Ce n’est pas une hypothèse. C’est une prédiction structurelle de la neurologie du développement, cohérente avec ce que l’on a observé lors de l’adoption massive des calculatrices dans l’enseignement, et plus récemment avec les GPS et l’orientation spatiale.

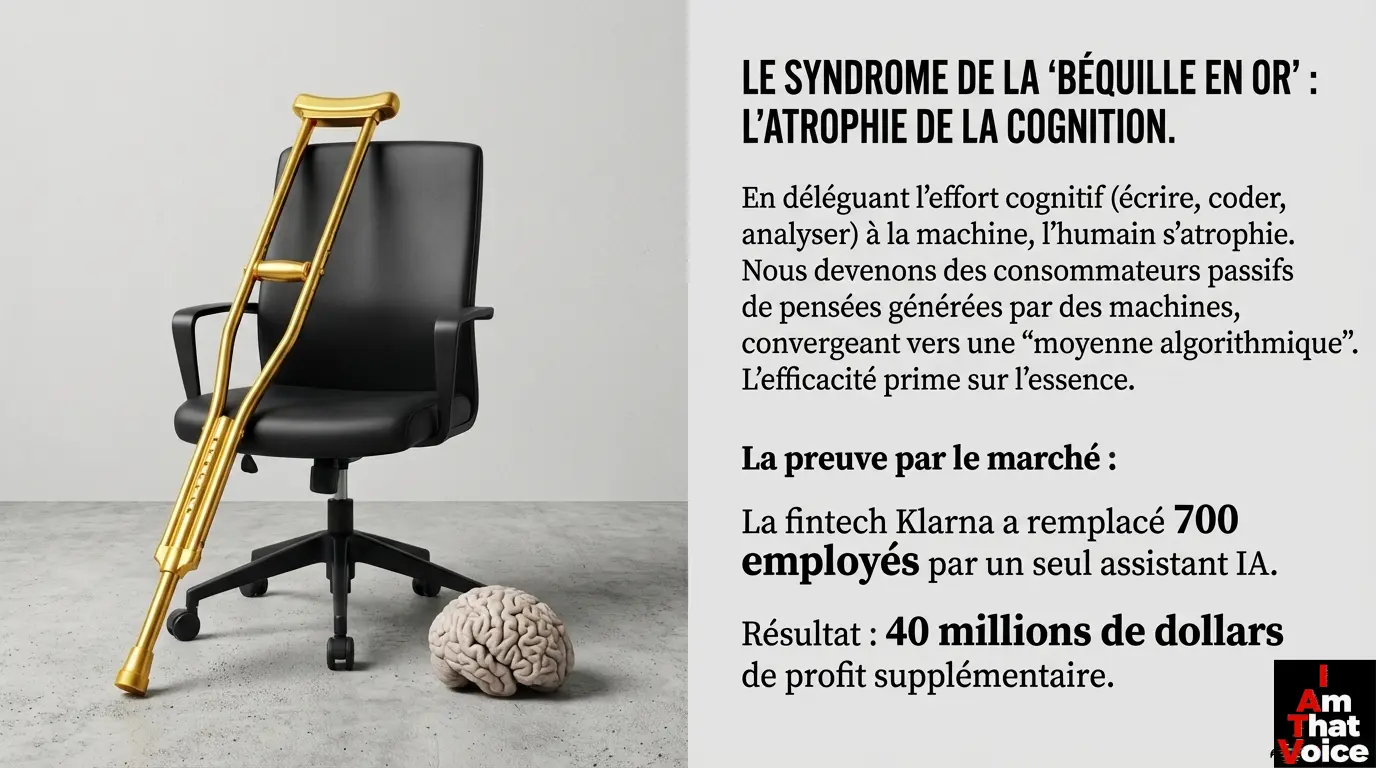

Le syndrome de la “béquille en or”. Ce que les institutions prennent pour une libération cognitive est en réalité une prothèse. À force de ne plus exercer nos propres circuits synaptiques, nous oublions comment marcher sans assistance, préparant l’analphabétisme des générations futures.

Le syndrome de la “béquille en or”. Ce que les institutions prennent pour une libération cognitive est en réalité une prothèse. À force de ne plus exercer nos propres circuits synaptiques, nous oublions comment marcher sans assistance, préparant l’analphabétisme des générations futures.

Si l’électricité se coupe, si le service s’interrompt, si le modèle est indisponible ou corrompu — une génération formée à déléguer est incapable de produire de la complexité par ses propres moyens. Nous avons brûlé nos vaisseaux cognitifs non pas en un geste héroïque, mais en une série de micro-délégations quotidiennes qui paraissaient toutes raisonnables, prises séparément.

La menace cognitive de l’IA n’est pas la désinformation individuelle. C’est l’atrophie collective, silencieuse et progressive, de la capacité humaine à penser contre la moyenne.

La moyenne est le niveau de la médiocrité confortable. Tout ce qui change le monde en est éloigné.