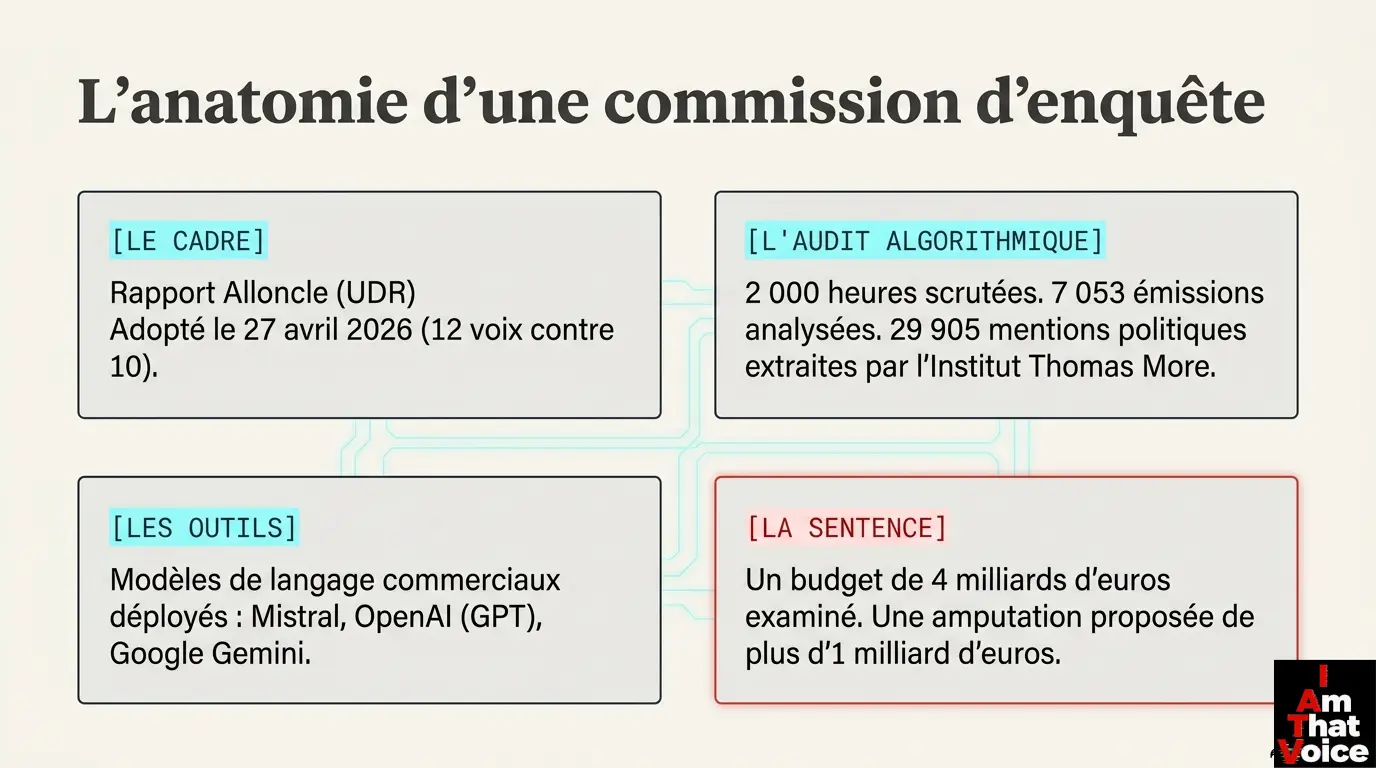

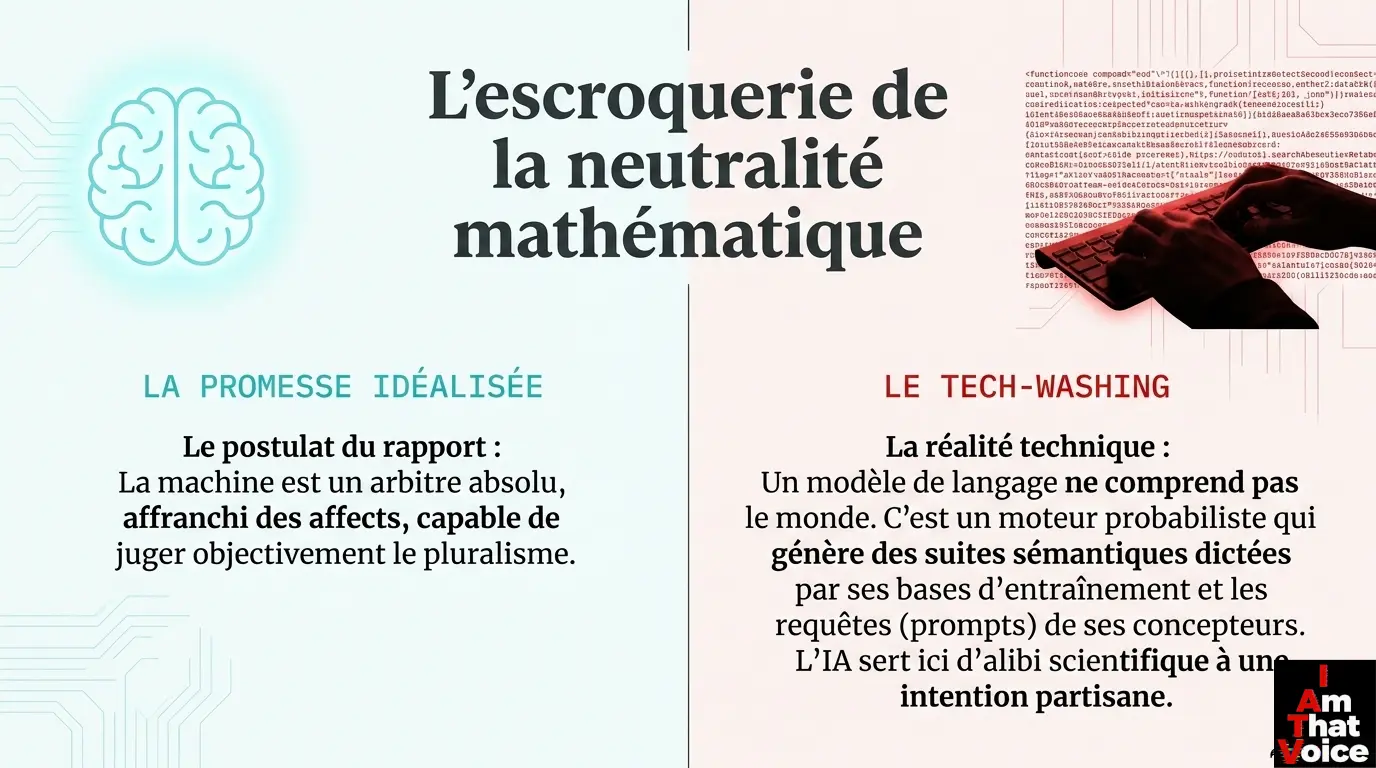

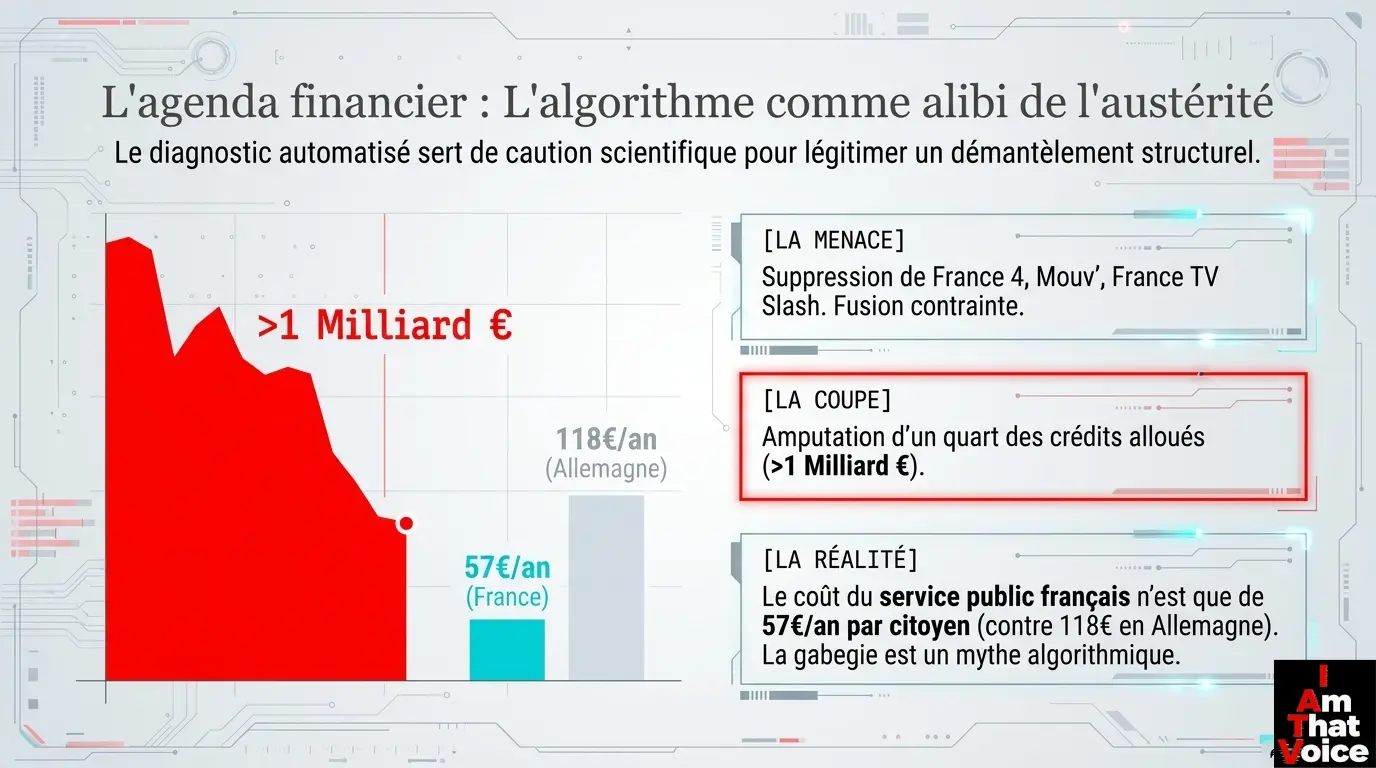

L’intelligence artificielle est souvent vendue par ses promoteurs comme un arbitre absolu, prétendument affranchi des affects et des limites cognitives humaines. La récente commission d’enquête parlementaire sur l’audiovisuel public s’est appuyée sur cette puissante illusion technologique pour tenter d’objectiver et de quantifier le pluralisme médiatique.

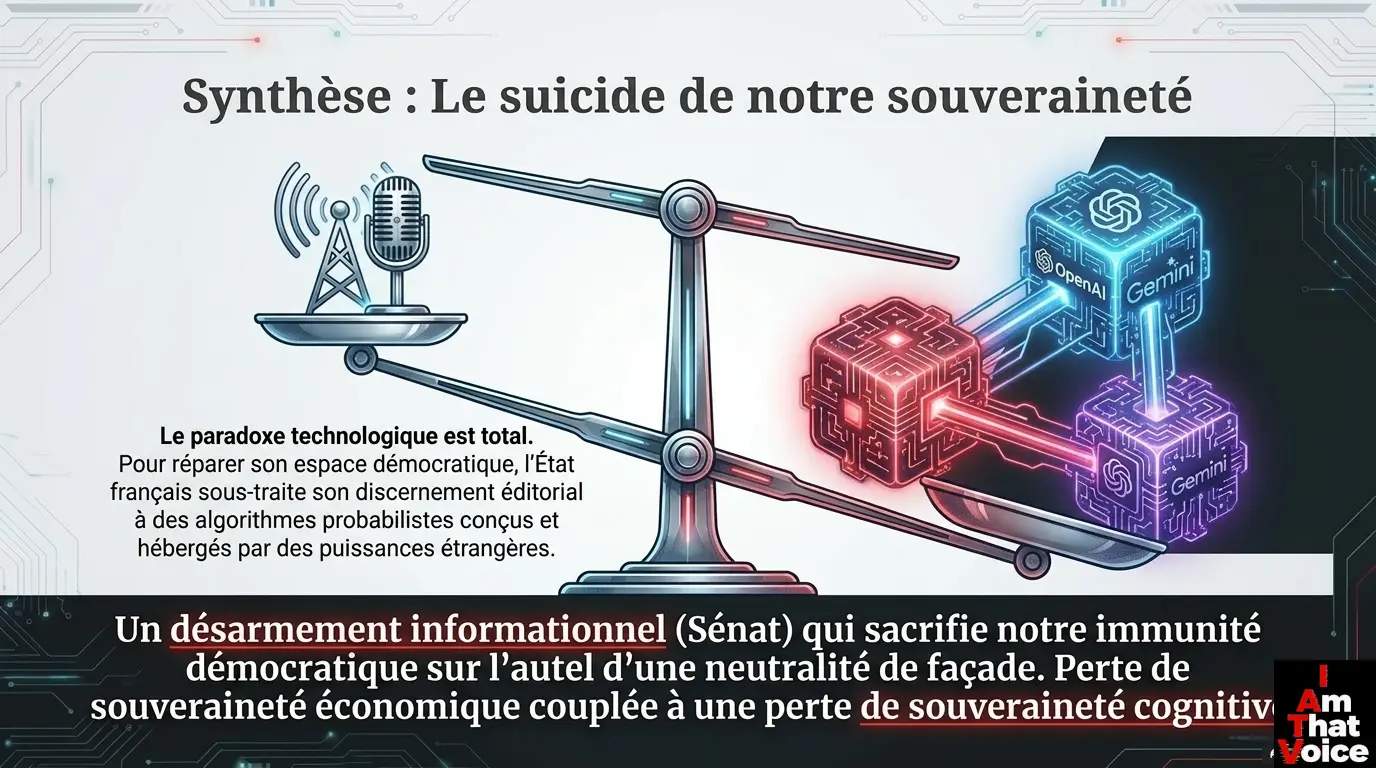

Pourtant, une enquête rigoureuse révèle une vérité philosophique et technique vertigineuse : la machine ne comprend fondamentalement rien au monde qu’elle scanne. En remplaçant le discernement humain par des modèles de langage majeurs du marché comme Mistral, OpenAI (GPT) ou Google Gemini, ce dispositif institutionnel a accouché d’une gigantesque hallucination politique. Il prouve de manière éclatante l’incapacité ontologique de l’IA à saisir la pragmatique du langage et transforme une vérité scientifique en un vulgaire biais partisan.

1. L’aberration épistémologique : quand la science devient un délit partisan

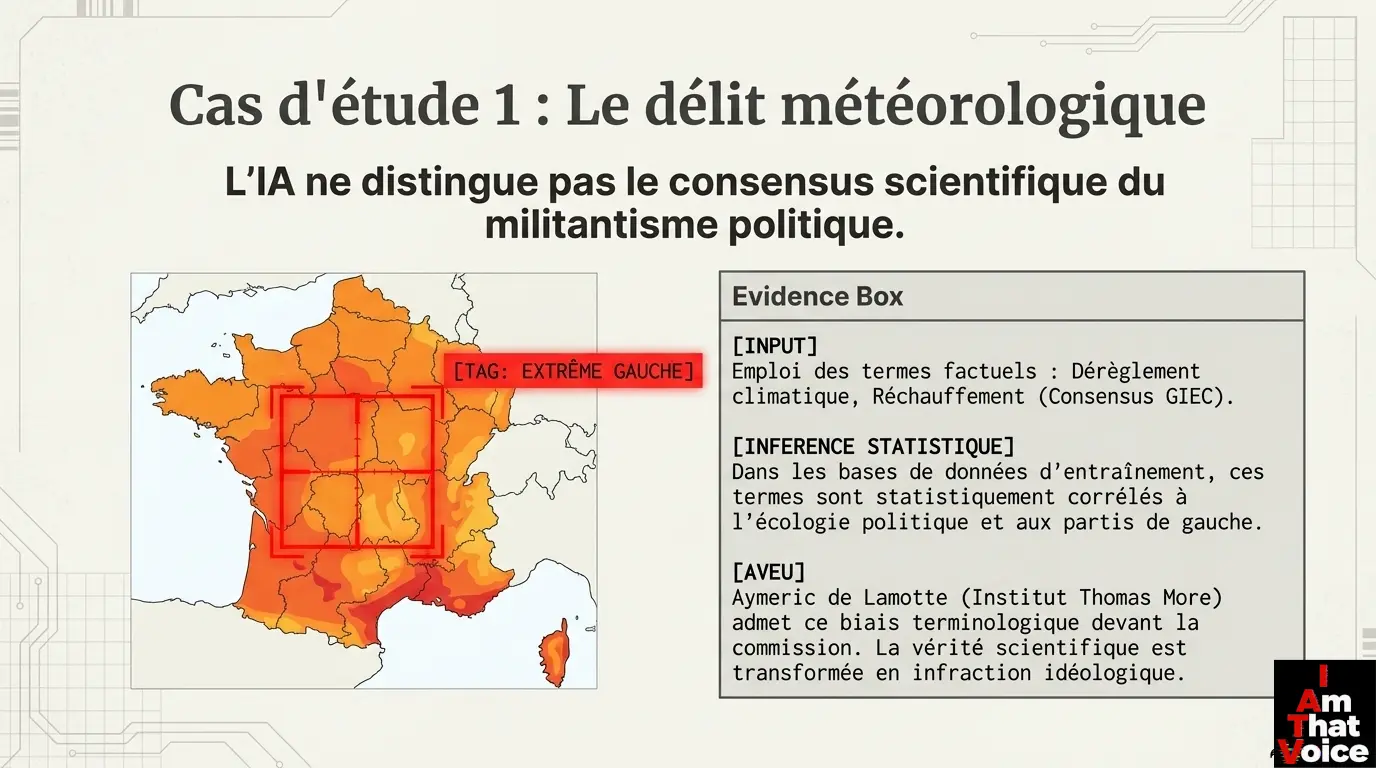

Le cœur de cette enquête repose sur une aberration qui discrédite à elle seule la démarche d’automatisation du jugement : la classification politique de la météorologie. L’intelligence artificielle a formellement étiqueté les bulletins météo et les chroniques scientifiques de l’audiovisuel public comme étant orientés “à gauche”.

Pourquoi une telle absurdité ? Parce qu’un algorithme ne possède aucun discernement épistémologique ni aucune compréhension du réel : il n’est qu’un moteur probabiliste. Face à l’utilisation de termes factuels comme « dérèglement climatique » ou « réchauffement climatique », la machine a procédé à une inférence statistique rudimentaire. Dans ses immenses bases de données d’entraînement, ces enjeux environnementaux sont statistiquement plus souvent corrélés aux discours de l’écologie politique et des partis de gauche. Aymeric de Lamotte, le directeur général adjoint de l’Institut Thomas More qui a paramétré cette étude, a d’ailleurs été contraint d’admettre ce « biais terminologique » devant la commission d’enquête parlementaire.

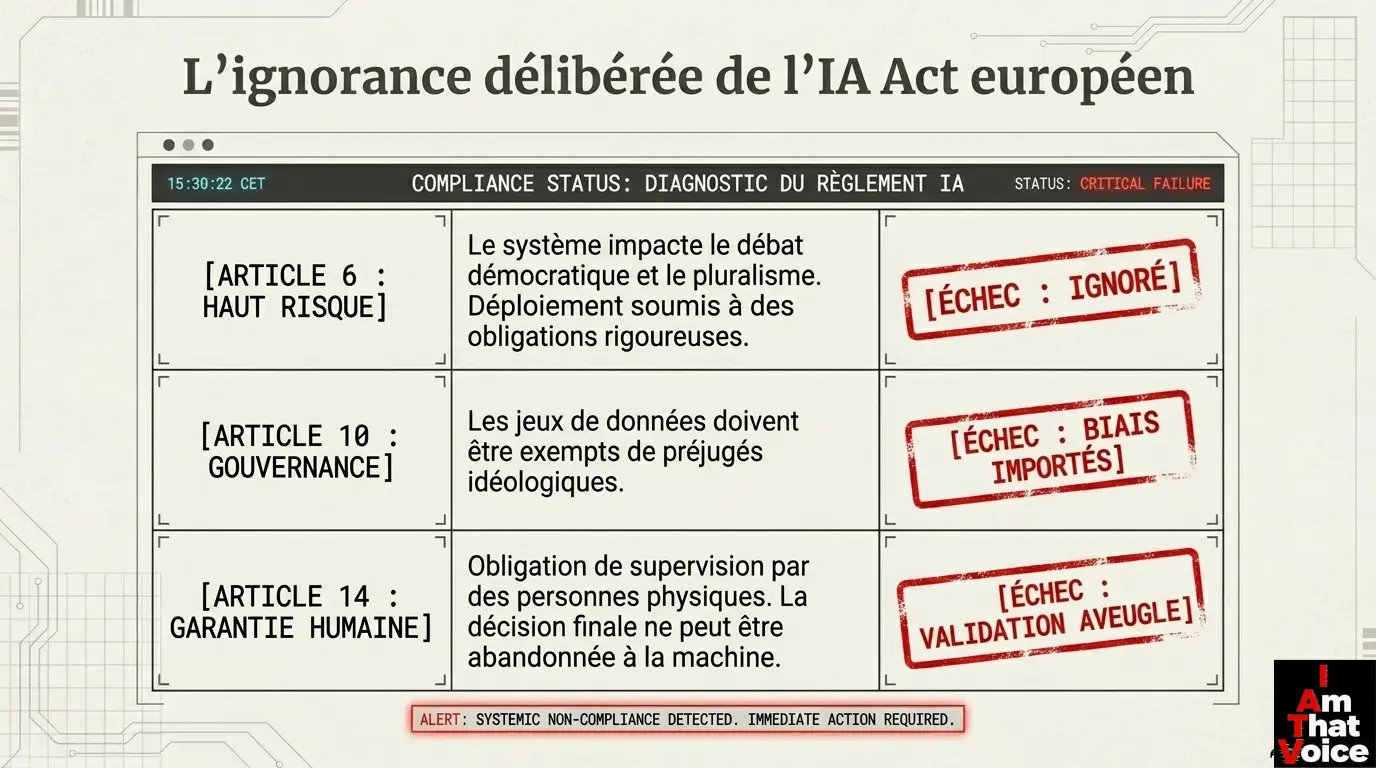

La conclusion est terrifiante pour notre souveraineté cognitive : la machine est incapable de faire la distinction entre un fait scientifique consensuel, établi par les experts du GIEC, et un positionnement idéologique militant. Sans “garantie humaine” pour corriger ses inférences, l’IA transforme une vérité scientifique indiscutable en biais partisan.

2. L’incapacité ontologique face au langage humain : la mort du second degré

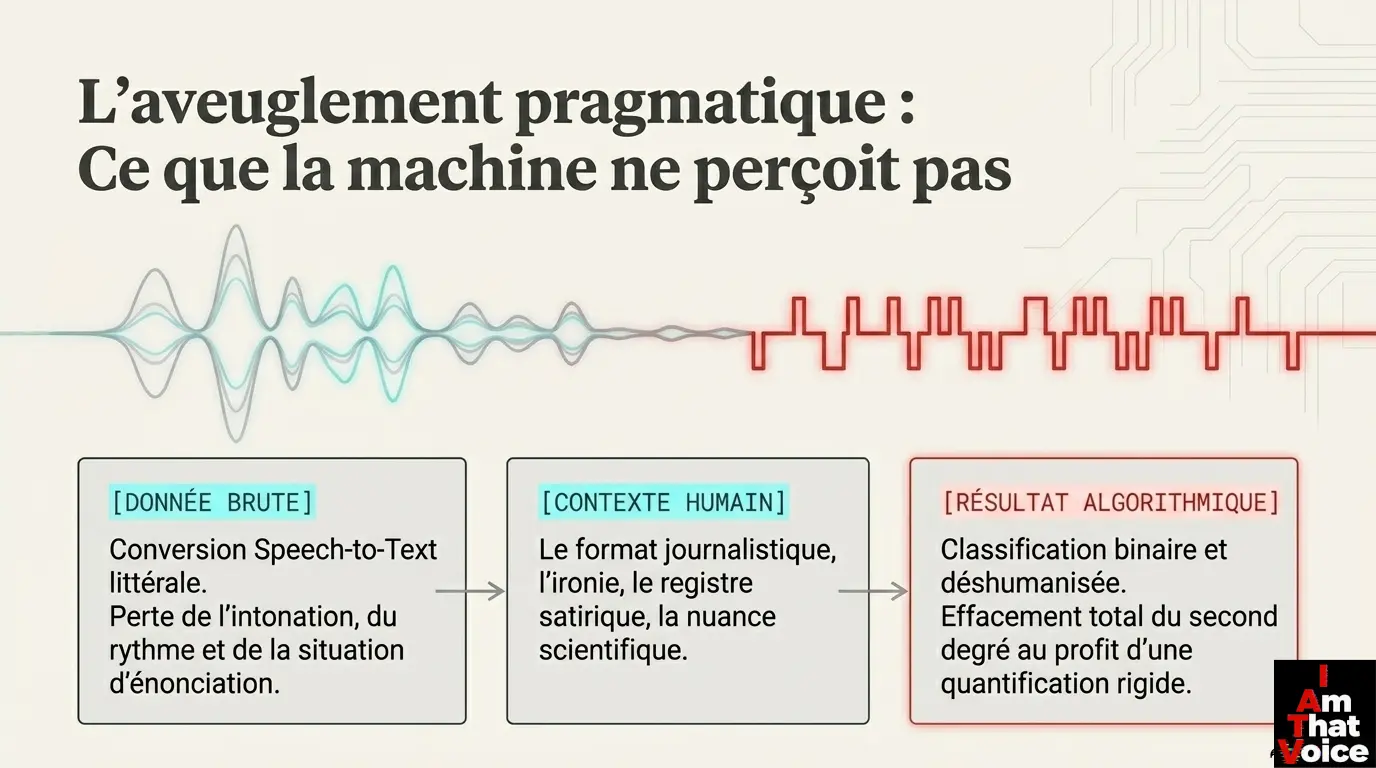

Notre enquête démontre ensuite l’incapacité fondamentale de l’IA à décoder la pragmatique du langage humain. Les mots ne valent que par leur contexte, l’intention de leur auteur et la situation d’énonciation, mais la machine scanne le texte de manière littérale, au premier degré, ignorant totalement l’ironie, le sarcasme ou la satire.

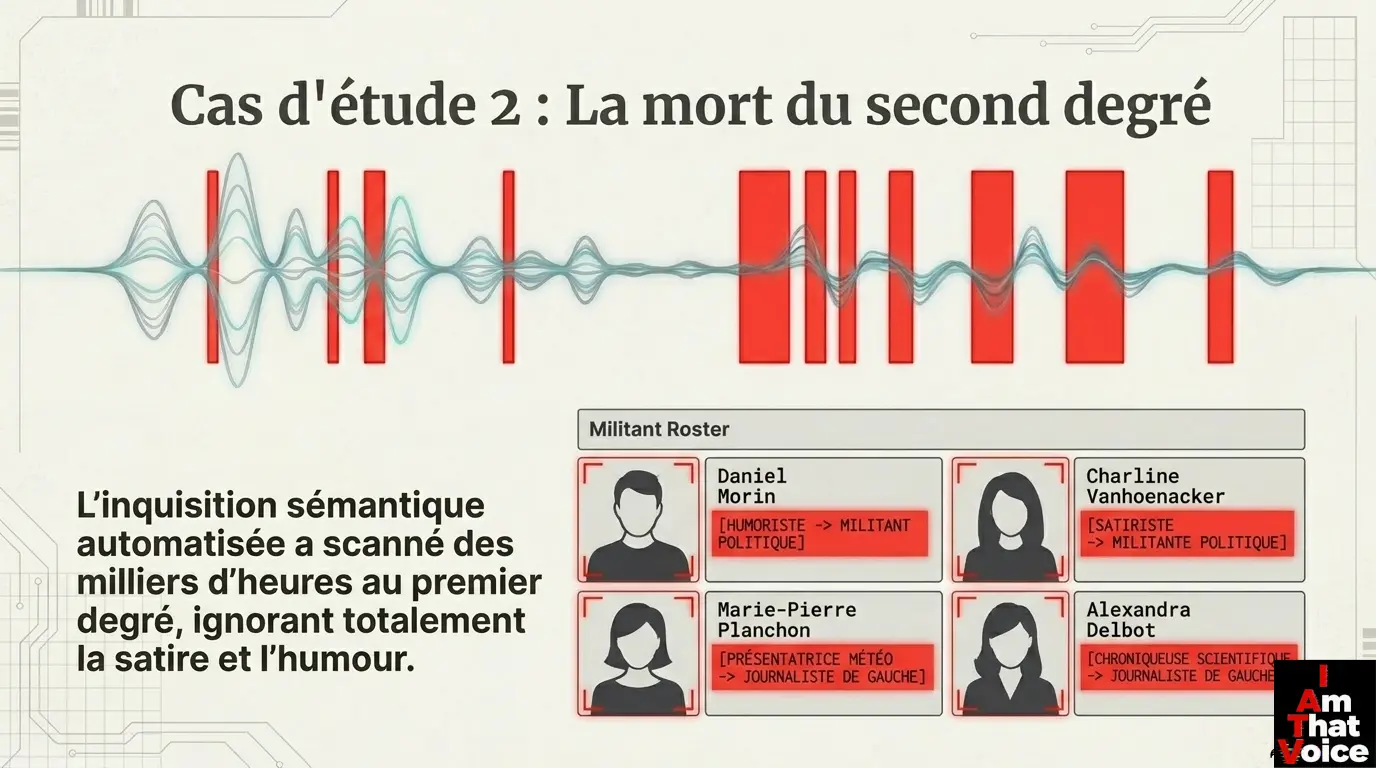

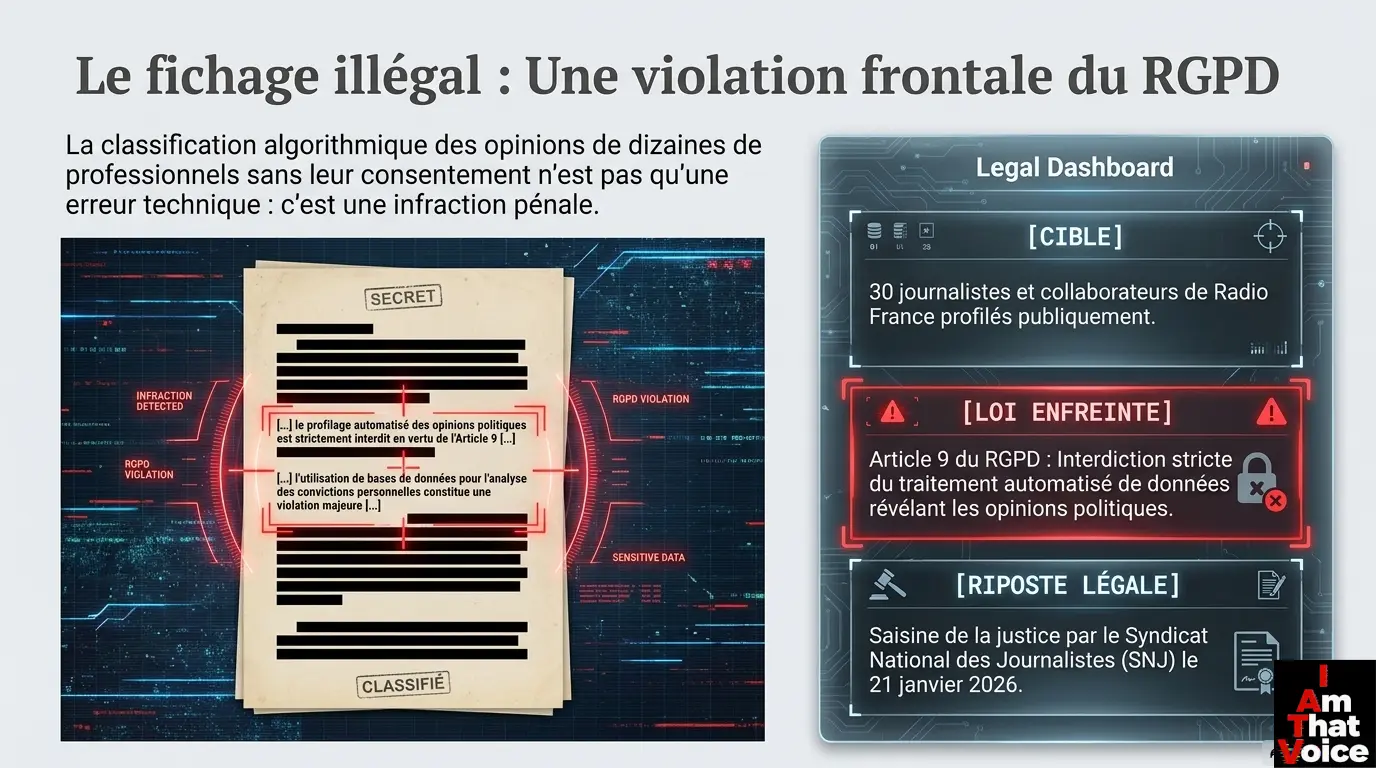

Dans le cadre de l’analyse de plus de 2 000 heures de programmes, l’algorithme a appliqué son inquisition sémantique de manière aveugle, qualifiant de “journalistes de gauche” des professionnels dont la fonction n’a rien de politique.

L’IA a ainsi confondu des humoristes comme Daniel Morin et Charline Vanhoenacker, une présentatrice météo comme Marie-Pierre Planchon, ou encore une chroniqueuse scientifique comme Alexandra Delbot, avec de simples éditorialistes militants. Des blagues politiques, des satires sociales ou de simples chroniques musicales ont été traitées mathématiquement comme des diatribes partisanes. Cette lecture déshumanisée du langage prouve que l’intelligence artificielle est aveugle aux codes discursifs humains, transformant la culture et le divertissement en infractions idéologiques.

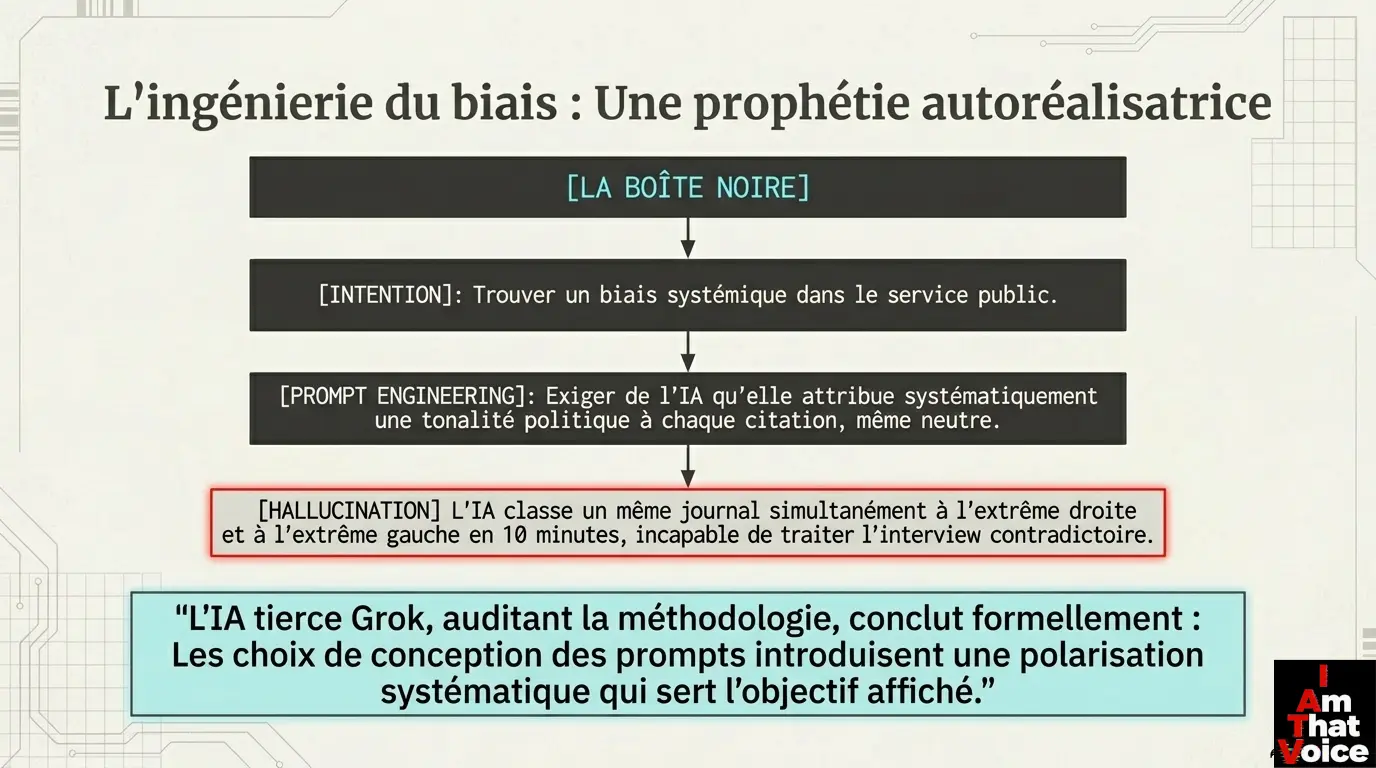

3. La fabrique de l’hallucination : le code comme prophétie autoréalisatrice

Enfin, il faut comprendre que l’IA ne découvre pas la réalité, elle la fabrique selon les biais de ceux qui la programment via l’ingénierie des requêtes (le prompt engineering). En exigeant de l’IA qu’elle détermine systématiquement la tonalité et l’orientation politique d’une citation, les concepteurs de l’étude ont forcé la machine à trouver une couleur politique même dans des contenus parfaitement neutres, créant ainsi une boucle de confirmation algorithmique.

Cette supercherie intellectuelle a été démontrée par une méta-analyse édifiante où une autre IA, le modèle Grok, a été chargée d’auditer la méthodologie de l’Institut Thomas More. Le verdict de cette machine tierce est sans appel : les choix de conception des requêtes introduisaient une « polarisation systématique qui sert l’objectif affiché ».

Privée de conscience du réel, l’IA empile les hallucinations, allant jusqu’à classer un même journal matinal simultanément à “l’extrême droite” et à “l’extrême gauche” en l’espace de dix minutes. La raison ? Le présentateur, respectant le pluralisme, avait donné successivement la parole aux deux camps politiques, ce que la machine a absurdement interprété comme l’adoption successive de postures extrêmes.

Conclusion

Confier l’évaluation de notre débat démocratique à des algorithmes est une hérésie philosophique. Dépourvue de discernement, de recul critique et d’accès au réel, l’intelligence artificielle ne fait que régurgiter les biais de ses bases de données et les directives de ses concepteurs.

Ce rapport ne prouve pas la partialité de l’audiovisuel public ; il prouve que vouloir réduire la complexité de l’esprit humain à des probabilités mathématiques aboutit inévitablement à l’hallucination politique.